Que vous le vouliez ou non, le contexte dans lequel vous évoluez change. Nouvelles attentes des consommateurs, nouvelles tendances, nouvelles réglementations, nouveau contexte concurrentiel... Ces éléments externes s'ajoutent aux changements que vous faites vous-mêmes : nouveaux produits, nouvelles aptitudes, nouvelles embauches, nouveau processus ou nouveau système informatique... Tout change dehors, et tout change dedans.

Deux défis se posent alors. Et c'est à Luc de Brabandère, de Boston Consulting Group, que l'on doit ces observations pertinentes. D'abord, vous devez décider d'un rythme acceptable pour "arrêter la machine" et réfléchir. Cette fréquence dépend de votre industrie, de votre capacité à inventer de nouvelles solutions ou d'opérationnaliser le changement.

Deuxième défi : vivre avec vos décisions raisonnablement. Si vous décidez d'une nouvelle stratégie chaque semaine, votre organisation ne pourra pas suivre. Vous devez donc attendre le "prochain rendez-vous" stratégique pour prendre une nouvelle décision. Il se crée alors un stress qui repose sur les épaules des gestionnaires : être tentés de changer... mais devoir attendre, pour ne pas devenir une "poule sans tête".

Le troisième défi : créer un équilibre entre agilité et constance.

C'est à l'auteur John Coleman, collaborateur régulier du Harvard Business Review que l'on doit cette observation et propose un cadre de réflexion intéressant pour avancer. Il oppose l'agilité et la constance sur deux axes, ce qui permet d'identifier quatre profils d'entreprise.

Manque de sérieux : ni inspirantes, ni fiables, ces organisations n'ont aucune chance d'être comprises en interne ou à l'externe.

Manque de focus : certaines startups sont très agiles, mais elles manquent du focus nécessaire à rassurer les employés, les actionnaires, l'industrie, etc.

Trop de rigidité : de l'autre côté du spectre, les grandes organisations, les institutions financières ont une obligation morale à "protéger et servir". C'est ce qu'on attend d'elles. Mais cette fiabilité vient avec un coût : la rigidité.

Le Graal : la position désirée, c'est un équilibre entre l'agilité et la constance. Oui, mais comment? Nos missions en entreprise nous permettent d'émettre une théorie très très simple. Très.

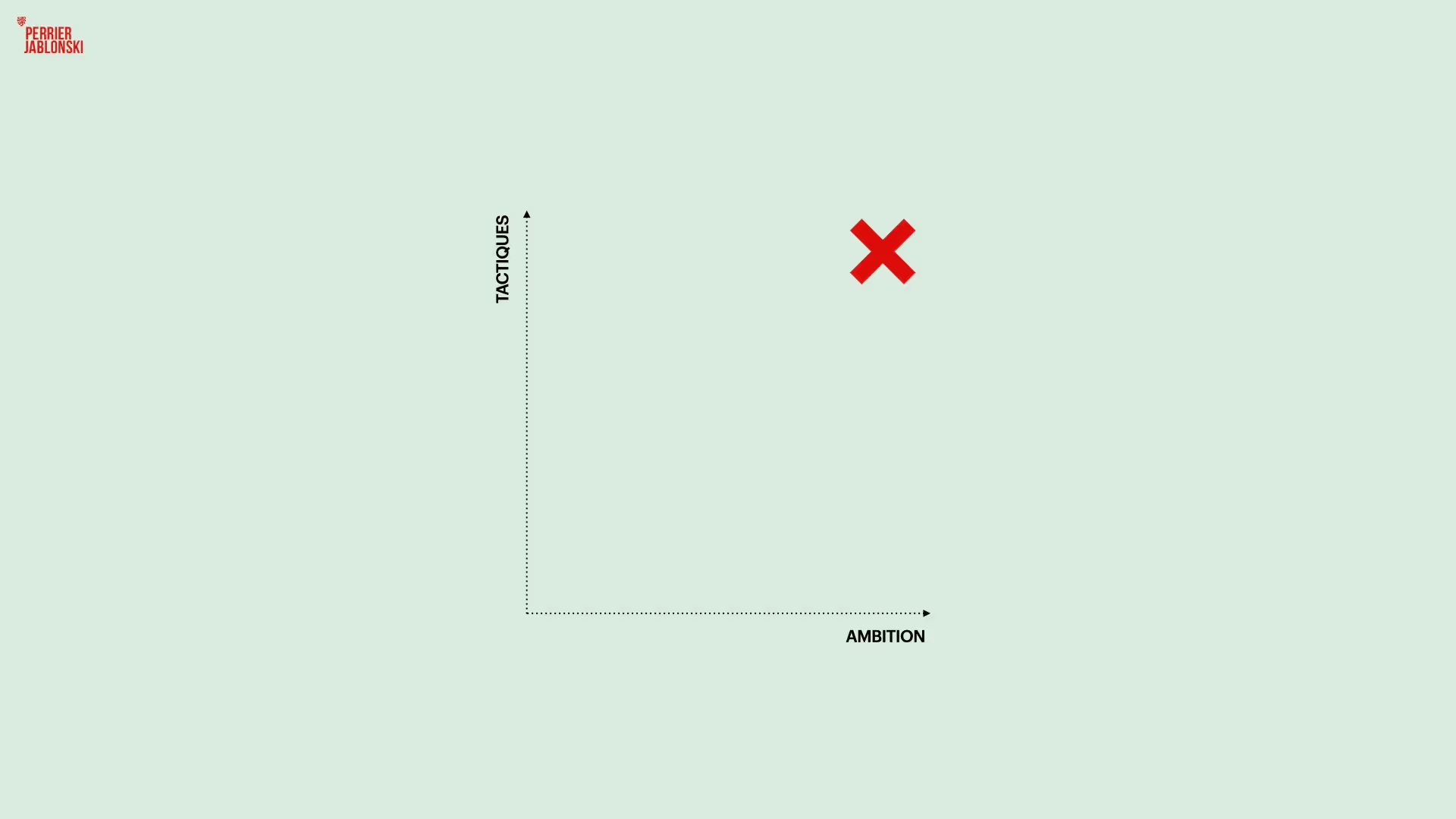

Afin de devenir une entreprise cohérente, il faut créer un écosystème de décisions cohérent. D'abord, avec une ambition claire (ce que certains appellent une vision). C'est votre destination désirée, et réaliste : nous voulons devenir cela. Ensuite, cette ambition doit devenir le filtre actif de toutes les tactiques de votre plan. Posez-vous la question suivante : ce petit pas tactique mène-t-il au bon endroit stratégique? Si la réponse est oui, alors vous devez avancer. Sinon, vous savez quoi faire...

Tout change tout le temps... dehors comme dedans. Il convient alors de vous fixer une fréquence de réflexions stratégiques, et de résister à l'envie de tout changer tout le temps. Pour devenir un gestionnaire stratégique, il faut créer un équilibre entre l'ambition de l'entreprise (sa destination stratégique) et les décisions du quotidien, les tactiques. Chaque tactique, aussi infime soit-elle, est un petit pas dans la bonne direction, si seulement elle est cohérente avec l'ambition... alors qu'un pas avec la mauvaise orientation stratégique vous fera immanquablement perdre du temps, de l'énergie... et de l'argent.

Le monde change à un rythme effréné, et chaque entreprise doit s’adapter si elle veut rester pertinente. Mais la tâche semble parfois trop grande et la montagne trop élevée à gravir. Alors, comment y parvenir ?

Une réponse très intéressante à cette question nous provient du monde du sport. En 2002, David Brailsford s’est vu confier la responsabilité de l’équipe moribonde de cyclisme du Royaume-Uni. Le défi était de taille: en 100 ans d’histoire, l’équipe n’avait remporté qu’une seule médaille d’or. Suite à l’arrivée de Brailsford, l’équipe a connu toute une transformation: elle a décroché sept médailles d’or à Pékin en 2008, avant de répéter l’exploit à Londres en 2012 et à Rio en 2016. En octobre 2015, il a expliqué comment son équipe et lui sont parvenus à renverser la tendance, dans le cadre d’une entrevue auprès de Harvard Business Review.

Toute la philosophie de l’équipe de Brailsford est basée sur trois grands piliers, qu’ils surnomment “les principes du podium”:

La théorie des gains marginaux devient particulièrement importante pour les piliers 2 et 3. Selon Brailsford, il faut penser petit, c’est-à-dire segmenter en différentes facettes l’entraînement en cyclisme, et tenter d’améliorer de 1% chacune de ces facettes. C’est de cette façon que l’équipe a modifié les programmes alimentaires, les techniques d’entraînement, ainsi que plusieurs petits détails de la vie quotidienne. Par exemple, pour assurer un sommeil optimal aux cyclistes, ces derniers voyageaient avec leur oreiller et leur matelas personnel lors des compétitions internationales. L’équipe allait même jusqu’à ne serrer aucune main lors des compétitions afin d’éviter de contracter une maladie infectieuse.

La théorie des gains marginaux s’applique aussi parfaitement en entreprise ou dans n'importe quelle autre forme de structure. Les gestionnaires qui désirent mobiliser leur personnel face au changement réussiront s’ils affrontent le changement 1% à la fois.

Chez Perrier Jablonski, nous sommes de grands adeptes du "modèle de Doblin" : une revue de 10 types d’innovation (que nous avons élargi à 12) pour être sûrs de ne rien oublier quand vient le temps de penser l'innovation. Ce modèle, inventé par Doblin (la branche innovation de Deloitte) segmente l’organisation en dix chantiers d’innovation, comme la structure organisationnelle et la marque, sur lesquels les gestionnaires peuvent agir pour innover au sein de leur organisation.

C'est à Richard Buckminster Fuller que nous devons la théorie de la Knowledge Doubling Curve, une prédiction dictée en 1980 et qui se vérifie aujourd'hui.

Bucky était le mauvais garçon de la Silicon Valley. Plusieurs fois viré de Harvard, il est devenu une inspiration pour le mouvement cybernétique et un gourou pour la communauté technologique naissante des années 60. Véritable touche-à-tout, architecte, designer, inventeur fou et futurologue, il est le papa de la biosphère de Montréal, et celui d'une théorie : la connaissance collective est exponentielle.

Cette théorie a peu été relayée par les universitaires de l’époque, mais tout s’explique par la réputation académique de Bucky. Or, aujourd’hui, elle résonne comme une véritable prédiction. L’idée : la connaissance collective à vitesse exponentielle. Attention, pas l’intelligence collective, la connaissance collective !

Il fallait 100 ans pour que la connaissance collective double en 1900.

Il fallait 25 ans pour que la connaissance collective double au milieu du siècle dernier.

Il fallait 13 mois pour que la connaissance collective double en 2016.

IBM a même poursuivi ces projections et annonce que le savoir doublera toutes les... douze heures, en 2036.

Pensez au corpus de connaissances de la médecine De Humani Corporis Fabrica (sur la structure du corps humain), qui fut l’œuvre majeure d’André Vésale, et véritable référence pour tous les scientifiques du xvie siècle. Tout était là. Toute la connaissance de la médecine rassemblée dans une seule œuvre publiée en 1543. Ce fut un tournant dans l’histoire de la médecine et de l’étude de l’anatomie humaine. Cet ouvrage était si imposant qu’il est souvent confondu avec une encyclopédie en raison de sa vaste couverture du sujet et de sa contribution fondamentale à la compréhension du corps humain. Tout le savoir de l’humanité sur l’humain ! Bon, eh bien De Humani Corporis Fabrica comptait 659 pages illustrées. Imaginez, en moins de 700 pages, on savait tout sur tout, sur la médecine du xvie siècle. Imaginez maintenant le volume de connaissances que nous avons sur le corps humain aujourd’hui !

Ou pensez encore à l’effervescence des sciences après la Deuxième Guerre mondiale, en partie produite par la fuite des cerveaux d’Europe centrale vers les universités américaines après l’élection d’Hitler en 1933. Tous les grands campus américains ont hérité de ces exilés allemands, autrichiens, hongrois, polonais expulsés par le régime nazi — notamment grâce à la fondation Rockefeller. Cette dernière mit en place un fonds d’aide spéciale pour les chercheurs destitués (Aid Fund for Deposed Scholars) destiné à financer des universitaires et intellectuels européens contraints de fuir le nazisme. Entre 1933 et 1942, ce programme permit d’aider plusieurs centaines d’intellectuels à trouver refuge sur des campus américains. Sans faire d’angélisme — l’accueil des chercheurs juifs était tout de même timide : il suffit de s’intéresser au parcours d’Einstein pour s’en convaincre —, ces années furent fructueuses sur le plan scientifique.

Les disciplines se croisèrent, les savoirs s’entrechoquèrent, et de nouveaux modes de pensée ont émergé de ces mélanges. C’est la naissance de la hiérarchie des besoins et des motivations de Maslow, c’est le début du design thinking, des focus groups, de l’informatique de Von Neumann en 1945, et bientôt de l’intelligence artificielle en 1955, avec la fine équipe de Dartmouth.

Ces inventions, combinées, ont accéléré davantage la production de connaissances, liée depuis à la puissance des ordinateurs. Depuis l’invention de l’ordinateur, la recherche est liée à la puissance des microprocesseurs, avec une loi bien connue (et parfois contestée), la loi de Moore. Gordon Moore était un des cofondateurs d’Intel, et un des papas du microprocesseur. Sa loi n’est pas tant une loi physique qu’une observation empirique, mais elle a fait foi pendant des décennies. Voilà ce qu’elle dit : à coût constant, la vitesse des microprocesseurs double tous les 18 mois. Une prédiction de 1965 — que Buckminster Fuller avait anticipée plusieurs années auparavant — restée vraie jusqu’en 2015, la physique imposant des barrières naturelles à la progression de cette vitesse. Moore avait lui-même prévu la limite de sa propre loi. Une limite physique insurmontable, puisqu’en dessous d’une échelle nanométrique (sous 10 nm), il devient difficile de miniaturiser davantage les microprocesseurs sans faire face à des problèmes complexes : effets quantiques, dissipation thermique, limitations de la lithographie, etc. Dès lors, il a été plus facile de multiplier les processeurs que de miniaturiser les microprocesseurs.

C’était sans compter le génie des équipes de Jensen Huang, grand patron de NVIDIA. En 2019, il déclare la mort de la loi de Moore et qu’il faudra désormais compter sur d’autres types de technologie… Optimisation des architectures, parallélisation des cœurs de processeurs et spécialisation des microprocesseurs (notamment les GPU) ont révolutionné l’approche de l’informatique matérielle. L’accélération des ordinateurs est redevenue possible, accélérant encore et encore la production de connaissances.

Aujourd’hui, les chercheurs ne cherchent plus. Ils ont produit des IA capables de chercher à leur place, donc de plus en plus vite. Par exemple, cette IA nommée M3GNet, développée par l’Université de Californie, a « inventé » une base de données de plus de 31 millions de nouveaux matériaux inexistants, en prédisant également leurs propriétés. Grâce à M3GNet, l’humanité découvre de nouveaux matériaux à une vitesse totalement inédite, vertigineuse.

Alors ? Buckminster était-il fou de considérer que la connaissance allait grandir à une vitesse exponentielle ? Au-delà de notre ressenti, quelle preuve tangible peut-on produire pour montrer le bien-fondé de son intuition ? La réponse est arrivée chez Perrier Jablonski au détour d’un mandat, pour lequel nous avions à creuser le sujet. Nous sommes tombés sur une étude édifiante, celle de l’American Clinical and Climatological Association, publiée en 2011.

Cette étude voulait alerter l’administration Obama sur les défis de la formation des médecins, dans un monde où la connaissance grandit si vite. Et le rapport donne des chiffres. Évidemment, ces chiffres sont faciles à obtenir à une époque où tout se compte (brevets, recherches, mémoires, etc.). Les voici.

Il fallait 50 ans pour que la connaissance médicale double en 1950, 7 ans en 1980, 3 ans et demi en 2010... et... 73 jours en 2020. Un étudiant qui a commencé ses études de médecine en 2010 est devenu médecin en 2017. Dans ce même laps de temps, la connaissance médicale a doublé trois fois.

Si vous pensiez que le monde allait certainement ralentir un jour, j’ai une réponse pour vous. Enfin, pas moi, mais le président de Google, Sundar Pichai, qui annonçait en 2019 les premiers tests du premier processeur quantique, le Sycamore 54-qubit. Sycamore a réalisé un calcul complexe en 3 minutes et 20 secondes... alors qu’il faudrait 10 000 ans aux meilleurs super calculateurs du marché. Bien évidemment, il s’agit d’un test réalisé dans des conditions impossibles à reproduire dans le quotidien... Mais ce n’est qu’une question de temps.

Trois minutes contre 10 000 ans. Non, l’accélération n’est pas prête de ralentir...

Le jeune philosophe est un pur-sang de la droite catholique française, maire-adjoint de Versailles et délégué à la Jeunesse et à l'Enseignement supérieur. Un esprit sain dans un corps sain de gendre parfait, de chemisette bien repassée de curé de paroisse potentiel. J'exagère à peine, puisque notre candidat est engagé contre l’avortement, contre l’adoption par des parents du même sexe, contre le mariage gay, contre l'immigration telle qu'elle est pratiquée en Europe, etc. Bref Bellamy n’a pas les atours du « candidat pour la modernité ».

Mais... je l'ai déjà dit (et peut-être déjà répété), un livre n'est pas un concours de beauté ou de popularité. J'aime lire des auteurs pour savoir comment il pensent avant de m'arrêter à ce qu'ils pensent. Dans ce cas précis, je ne pourrais pas être plus éloigné des idées politiques de Bellamy, et je déplore même qu'un esprit si habile soit au service d'idées si nauséabondes. Cela étant clarifié, Bellamy est un philosophe efficace, dans le sens où il apporte un regard interrogateur sur notre époque. Aussi, cet essai Demeure n'est pas politique le moins du monde... et il est passionnant.

Par ailleurs, si les opinions les tendances politiques du philosophe n'ont pas échappées aux critiques littéraires, tous reconnaissaient l'étanchéité entre le Bellamy-auteur et le Bellamy-politicien.

D'abord, Bellamy se défend d’être conservateur, et son essai contre « l’ère du mouvement perpétuel » est un exercice rhétorique finement mené, qui le rend difficile à identifier politiquement. C’est que cet esprit précoce ne dénonce pas le changement en soi. Il dénonce le changement sans but précis. Il accuse notre incapacité à nous « poser » et à définir ce qu’il appelle des points fixes — que nous appelions autrefois des valeurs, mais en politique les valeurs sont devenues l’argument des conservateurs, alors que le mouvement est celui de la modernité. Bref, Bellamy mérite toute notre attention pour proposer un contrepoids crédible à la panacée du changement, et à notre béatitude technologique.

“Je ne suis pas contre le progrès, bien au contraire. Mais l'erreur du moment est de penser que tout changement est un progrès”✱. Pour Bellamy, face à la transformation du monde par des outils technologiques que nous ne maîtrisons pas, face à la menace de la crise écologique, le rôle de la politique est peut-être de défendre des repères et donner du sens à ce monde.

Copernic et Galilée ont remis le monde en mouvement, le privant d’un coup de la stabilité rassurante d’un but à atteindre. Avant eux, il existait une fin, une ligne d'arrivée, un repos éternel. Depuis, tout est changement perpétuel, il n'y a plus de repère absolu — il n’est même plus certain que nous ayons à mourir un jour. Notre monde repose sur un socle où tout est remis en question dans ce que Bellamy appelle un progressisme sans destination. Il faut désormais définir des points fixes pour donner un sens.

Tout s’écoule, disait Parménide. Or, rappelle Bellamy, la rivière ne s’écoule que parce que la rive est immobile. Le mouvement ne vaut que s’il est observé d’un point fixe. C’est donc la fixité qui permet le mouvement. Au delà de la rhétorique abstraite, on peut s'interroger sur notre manque de destination. Nous allons tous quelque part. Nous y allons tous de plus en plus vite. Mais où allons-nous? « Où vas-tu Gilgamesh? » interrogeait le tout premier texte de notre civilisation.

C’est la question que nous nous posons depuis l’aube des temps. Quel est notre but? Dans quelle direction? La quête de sens porte bien son nom. Finalement, Bellamy veut sauver la possibilité du mouvement en fixant des repères, une destination, Il rappelle « qu’une chose est sûre : nous ne sortirons pas de la fascination du mouvement par l'éloge de l’immobilité », et propose « la sagesse du discernement ».

Aujourd'hui nous refusons la fixité. Nous voulons pouvoir négocier tout ce qui est. Nous ne supportons plus les limites spatiales, temporelles, biologiques. La technique nous a aidés à tout abolir. Nous voulons habiter sur Mars, voyager dans le temps, ou changer de sexe. Notre liberté ne supporte aucune dérogation. Le désir s’impose au déterminisme. Dès lors, l’idée (technophile) s’est imposée : si tout peut changer, alors tout doit changer. Oui, mais pour aller où? Mais où vas-tu Gilgamesh?

Et la famille est un point fixe fondamental pour Bellamy, qui précise ses positions sur la procréation. Sa rhétorique contre la procréation assistée mérite une écoute impartiale — quelle que soit notre idée personnelle sur le sujet, ce qui n'est pas évident. Bellamy y voit le signe d’un changement de paradigme dans le domaine de la santé, qui passe de l’humain réparé à l’humain augmenté, en répondant à un “désir que notre condition humaine ne satisfait pas”.

Il pose ainsi la question du rôle de la médecine : doit-elle répondre à tous nos besoins? Et cette question est parfaitement pertinente. Aujourd’hui personne ne peut contester l’utilité d’une couveuse pour sauver un prématuré ni le stimulateur cardiaque qui vient au secours de certains de nos aînés. Cette amélioration est un progrès indiscutable. Or, il s’agit bien ici d’une médecine d’optimisation, d’un corps augmenté par la technologie.

Pensez maintenant à la grossesse extra utérine demandée par certains groupes féministes de Californie pour une grossesse équitable — qui ne pénaliserait pas la mère — puisque la gestation se ferait totalement en dehors du corps. Au delà d’avoir été imaginée par Aldoux Huxley dans Le meilleur des mondes, l’ectogenèse est aujourd'hui une réalité, et les premiers tests ont été menés par Alan W. Flake et son équipe du Center for Fetal Research, de l'Hôpital pour enfant de Philadelphie. Des agneaux nés hors corps pour valider des recherches visant les humains. L'utérus artificiel, pour sauver de grands prématurés humains, ou pour éviter l'iniquité de la grossesse. Cette idée peut nous paraître choquante, farfelue ou immorale. Or, il ne s’agit que d’une question d'époque. Au milieu du XIXe on étouffait les enfants enragés entre des matelas✱. Au début du siècle dernier, on guérissait les femmes dépressives par la lobotomie, en perçant un trou dans leur crâne pour y prélever des morceau de cerveau (sans anesthésie, bien évidemment). Aujourd'hui nos grands-papas vivent avec des piles électriques dans le cœur, et demain nos mamans accoucheront extra utero.

Ce qui ressemble à un point fixe — la santé, la morale, la vie, la mort — est un repère mouvant, qui se déforme au gré des époques et des capacités scientifiques.

Notre définition contemporaine de la santé date de 1945. L’Organisation mondiale de la santé à imposé cette définition encore en vigueur aujourd'hui : la santé est un état de complet bien-être physique, mental et social. Jusqu’alors, la santé, c’était « le silence des organes » d'après la définition délicieuse de Paul Valéry. Et demain?

L'humain augmenté existe déjà. Celui d'aujourd'hui est une bénédiction. Celui de demain est une abomination. Simple question de timing.

Bellamy continue son réquisitoire en s'attaquant à l’économie, qui n’a bien évidemment pas échappé à cette fluidité — l’économie du stock et du patrimoine a laissé la place à l’économie du flux. La valeur d’échange a remplacé la valeur d’usage. Rien n’est plus fait pour être conservé, tout est fait pour être échangé — le plus souvent possible, le plus rapidement possible. Aujourd'hui les échanges boursiers se font à une vitesse d’une fraction de seconde, on préfère louer que posséder, rien n’est pensé pour durer.

Le travail aussi a changé. Autrefois il valorisait le métier, l’expérience, aujourd’hui il glorifie l’adaptabilité, la mobilité, la flexibilité. Tout le langage a changé. L’agilité a remplacé la sagesse. Et la « nouvelle économie » n’échappe pas à cet appétit du mouvement, entre les startups qui glorifient le démarrage — la mise en mouvement — et l’économie de partage, qui consiste à faire de l’argent avec ce qui était autrefois gratuit. L’hospitalité, l’autostop, le prêt d’outils. Le bon vieux coup de main est devenu une transaction. Jusqu’à La Poste française, qui facture désormais le petit bonjour du facteur à 19,90 € par mois pour cinq minutes par semaine. Mais où vas-tu Gilgamesh?

J'ai voulu faire le tour de la pensé de Bellamy, en la nourrissant d'exemples que j'ai pu moi-même pu observer. J'apprécie sa pensée des points fixes, du discernement et du jugement sur un avenir décidé. Je ne partage pas ses conclusions. Aucune d'elles. Bonne nouvelle, elles ne sont PAS l'objet de son essai — ce qui prouve que nous pouvons faire usage de sa réflexion et arriver à des destinations bien différentes. Alors je salue sa rhétorique, son courage et son bon sens, même si j'aurais préféré qu'il en fît un usage différent, au service d'une cause plus laïque et moins manipulée.

Je vous souhaite une lecture sage et dépassionnée de "Demeure", c'est un ouvrage riche, fort, et généreux.

Mobilité ou immobilisme? Deux mille ans plus tard, Galilée viendra départager ces deux écoles de pensée par l'observation du mouvement perpétuel de la Terre sur elle-même, et autour du Soleil. Le match se termine donc en 1610 avec la victoire du changement permanent, donc d'Héraclite.

Or, limiter Parménide et Héraclite au mouvement, c’est se priver d’une pensée beaucoup plus riche, bien plus intéressante, et plus profonde encore. Nous avons eu recours aux lumières de plusieurs philosophes pour éclairer notre chemin. D'abord l'illustre Jean-François Mattéi (1941-2014). Ensuite Barbara Cassin, philosophe spécialiste des philosophes grecs et enfin André Laks, professeur de philosophie ancienne à la Sorbonne.

Évidemment, il convient de mesurer les innombrables altérations de ces textes primitifs à travers l'histoire — des fragments qui nous sont parvenus partiels et transformés. Cependant, ils ont occupé les pensées de Platon, Aristote, Hegel, Heidegger, Nietzsche et bien d'autres... et préoccupent de nombreux philosophes contemporains. Ils ont le mérite de susciter chez le lecteur curieux des questionnements profonds et utiles.

Loin de moi la prétention d'ajouter une pierre à cet édifice. Je propose l'emprunt, la ruse. Je veux aller chercher à la source même, de nouveaux mécanismes, de nouvelles métaphores. Cet article s'adresse aux curieux. À celles qui n'ont pas peur des acrobaties. À ceux qui n'ont pas peur du feu. Bref, à celui ou à celle qui a déjà osé lire jusqu'ici.

D’abord, Parménide était le penseur du Tout, comme Pythagore avant lui. Il y avait l'être... et rien d’autre. Le non-être ne pouvant être amené à notre conscience est inexistant. Le fragment 6 trop simplement traduit par L'être est, le non-être n’est pas a donné beaucoup de travail aux philosophes, aux philologues et aux traducteurs, qui continuent encore aujourd'hui à se contredire sur le sens profond de cette pensée fondatrice.

Pour Parménide, il n'y a que deux voies possibles : est et n'est pas. Mais est — du grec esti — peut prendre plusieurs formes : il existe, il est possible, il y a. Aussi, la tautologie (une formule qui ne peut être que vraie) pose que si A est A, alors A est parfaitement A, et A n'est rien d'autre que A — c'est la naissance des axiomes mathématiques.

Le Tout se définit donc par tout ce qui ne change pas, par ce qui est permanent, immuable. C'est ce qui est vrai et qui restera vrai. C'est l'identité ontologique : ce qui se définit dans l'absolu. Dès lors, ce qui change n'est qu'opinion (doxa), éphémère et sans valeur. Dans le Tout se trouve l'idée d'une Unité de tout l’univers dans tous les temps. Le passé, le présent et l’avenir cohabitent... avec l'impossibilité du devenir.

Si la traduction pose quelques problèmes aux philosophes encore aujourd'hui, on peut aussi retenir que nommer le néant... c'est le détruire, puisque c’est lui donner une consistance. Le néant est donc impossible, impensable. Tout est, et c'est tout. Dès lors, Parménide propose un Tout « tout puissant », immuable, impossible à changer. Rien ne change jamais, donc.

Pour sa part, Héraclite propose l'idée que Tout est composé d'opposés. La route monte et descend en même temps, selon le sens qu’on prend. Le fleuve dans lequel on se baigne change chaque seconde, mais reste le même et unique fleuve qui porte pour cette raison le même et unique nom. Pour Héraclite le monde est tissé de contraires pour mieux affirmer son unité, et Héraclite fustige les hommes incapables de reconnaître ces jeux de contraires logiques, les privant alors du pouvoir de raisonnement.

Héraclite était le philosophe qui pleure, sans cesse effondré par l'attitude des hommes qui ne savaient que faire la guerre. Nietzsche en avait fait le philosophe du combat, en révélant que si Tout contient des contraires, il faut les départager. Une lutte s'enclenche alors entre ces deux possibles, pour que l'un des deux l'emporte. Pour Héraclite, tout est un combat potentiel pour décider d’une voie à prendre plutôt qu'une autre. Tout est alors composé d’un changement à venir, d’un état de transformation permanent. Tout change tout le temps, donc.

Tout devenir naît de la lutte des contraires. Les qualités définies qui nous semblent durables n’expriment que la suprématie momentanée de l’un des combattants, mais la lutte n'en continue pas moins, le combat se poursuit éternellement. C'est en fonction de ce combat que tout ce qui se produit advient et c’est précisément ce combat qui révèle la justice cohérente et sévère, liée à des lois éternelles. — Nietzsche.

C'est l'harmonie des paradoxes. Ce qui est différent de soi-même s’accorde avec soi-même. Et celui qui s'enferme dans son propre raisonnement est un rêveur isolé qui ne participe pas au raisonnement collectif. Ce penseur recroquevillé sur lui-même porte un nom en grec ancien : l'idiot. L'idiot n'est pas l'imbécile. L'idiot est celui qui ne croit que lui-même. Et la langue française a conservé une trace de ce sens, avec l'idiosyncrasie — une disposition à réagir de manière particulière aux agents extérieurs. Ici, particulière doit être pris dans le sens d'individuel.

Déjà à l'époque, jeu de dualités n'était pas nouveau. Sans rien ôter à ces deux fondateurs de la pensée, il convient tout de même de rendre à Pythagore ce qui lui revient. Sur le fronton de l'École qu'il créa à Crotone, on pouvait lire "Dieu a tiré la Terre du néant comme il a créé le Un du rien pour créer la multitude". Au-delà de l'incroyable poésie de cette sentence, on y perçoit toute la richesse philosophique qu'elle porte en elle. C'est le début du Tout, de l'unité, du rien et de tout ce qu'il y a entre eux.

Ces questionnements du rien et du tout, de l'unité et du multiple, du vrai et du possible, de l'harmonie et des opposés, ont forgé à la fois notre vision du monde, notre raisonnement, notre langage et nos mathématiques. Ils sont la source de tout. Par exemple, puisqu’il existe une frontière entre quelque chose et rien, que se passe-t-il précisément à cet endroit? Le calcul infinitésimal d’Archimède, Newton et Leibnitz répondra à cette question. Et puisqu’il existe plusieurs possibilités d’un présent à venir, comment s'organise ce choix? Ce sont ici les bases des mondes possibles de Leibnitz...

Pour finir, il est cocasse de souligner que l'unité (le Tout) est composée d'unités (les objets) qui se mesurent... avec des unités (poids, taille, etc.) Les unités des unités de l'unité. Un seul mot pour décrire l'infiniment grand et l'infiniment petit, le pourquoi, le quoi et le comment. Voilà une pensée parfaitement parmédienne, héraclitéenne... et pythagoricienne.

Nous l'avons déjà vu dans un article précédent, pour changer une habitude, il y a trois dimensions selon le Dr Fogg❶. D'abord la motivation (difficile à contrôler), ensuite la facilité (beaucoup plus efficace) et enfin le déclencheur (qui fait passer à l'action).

L'idée que l'effort crée l'obstacle n'est pas nouvelle. Pierre Louis Moreau de Maupertuis, mathématicien et philosophe français du XVIIIe, avait déjà formulé le "Principe de moindre action" — que l'on a appelé depuis le principe de Maupertuis. L'idée est simple : la nature tout entière est paresseuse, alors elle fonctionne toujours de la manière la plus efficace possible : pour toute action, elle va prendre le chemin le plus économe. Pas le plus court, pas le plus facile, pas la ligne la plus droite : la nature prend toujours le chemin le plus économe en énergie. Et ce qui s'applique à la nature physique s'applique nécessairement... à nous.

Richard H. Thaler et Cass Sunstein ont transformé ce principe universel en principe économique. À mi-chemin entre les sciences sociales et les sciences économiques, Thaler et Sunstein ont observé les biais comportementaux de leurs congénères, et ils ont largement documenté leurs trouvailles. Ils ont fini par démontrer que les humains avaient besoin d'un petit coup de pouce — a nudge, en anglais — pour prendre la bonne décision.

Le nudge est un mélange de simplification de la décision et de motivation à l'action. On parle parfois d'intervention douce, car ces coups de pouce sont imperceptibles, ludiques et le plus souvent plutôt sympathiques. On parle aussi parfois de paternalisme libertarien, mais gardons ça pour plus tard... Quoi qu’il en soit, Thaler a été récompensé pour cette démonstration (entre autres) par un prix Nobel d'économie en 2017.

L'un des exemples les plus célèbres de l'application des nudges concerne les toilettes pour hommes à l'aéroport d'Amsterdam. Pour réduire les problèmes d'hygiène causés par les éclaboussures d'urine, Aad Kieboom, un des responsables de l'aéroport a mis en place un nudge : une petite mouche dessinée et collée à l'intérieur des urinoirs, juste au-dessus du drain. Pourquoi? Parce que cette mouche donnerait un but aux utilisateurs. Conclusion? Aucun effort nécessaire + déclencheur ludique = réussite parfaite. Les éclaboussures ont diminué de 80% et les coûts de nettoyage de 6% (20 000€ par année).

La question légitime pourrait être « mais pourquoi une mouche? » Keiboom avait justifié ce choix en expliquant que l’idée était venue 20 plus tôt d’un homme de maintenance allemand qui avait servi dans l’armée dans les années 60, Jos Van Bedoff. Ce dernier avait déjà expérimenté des toilettes avec un point rouge, mais selon lui la mouche était une cible plus adaptée pour un humain habile : l’idée - bien militaire - de la domination de l’homme sur un insecte avait un certain sens. Mais encore une fois, ce nudge n’était pas nouveau : cent ans plus tôt, on avait déjà vu le même stratagème avec... une abeille. Les temps changent...

Ces détails seraient totalement anecdotiques si les nudges ne relevaient pas autant de la psychologie sociale des humains. Ils démontrent bien la subtilité de cet outil d'influence. D'ailleurs, il existe plusieurs catégories de nudges et des centaines d’exemples tantôt rigolos, tantôt brillants, tantôt malins et tous très stratégiques.

J’ai fait une liste plutôt fournie, en mélangeant des exemples originaux et les grands classiques des nudges — pour ces derniers, j’ai fait des recherches plus approfondies pour mieux les documenter. Voici donc les dix catégories de nudges que l'on a pu identifier.

L’idée est de choisir à la place des usagers quelle est l’option par défaut. Pour faire un choix différent, l’usager va devoir faire un effort conscient… ce qui a de grandes chances de ne pas arriver. Même une simple croix dans une case est un effort.

Le don d’organes est l’exemple le plus connu dans le monde des nudges❷. Une étude a comparé trois systèmes de don d'organes : le choix obligatoire, le consentement présumé (opt-out) et le consentement explicite (opt-in). Les résultats suggèrent que le choix obligatoire et le consentement présumé sont plus efficaces pour générer des donneurs enregistrés que le consentement explicite. En gros, si vous avez une case à cocher, c’est un effort de trop... Alors mieux vaut bien choisir la question posée. Au Québec, c’est le opt-in qui a été choisi. Donc par défaut, vous n’êtes PAS donneur. L’Espagne est la championne du monde du don d’organes avec 46,9 donneurs par million d’habitants. La Croatie suit avec 33,6 donneurs par million d’habitants. Le Pays de Galles vient de passer de 46% à 61% de volontaires. Leur point commun? Les trois ont opté pour… le consentement présumé (opt-out).

L’idée est de donner une information qui va faciliter la prise de décision aux usagers. Par exemple, Thaler et Sunstein ont montré que la mention du nombre de calories dans les menus des restaurants incitait les clients à choisir des plats moins caloriques. C’est devenu une norme depuis.

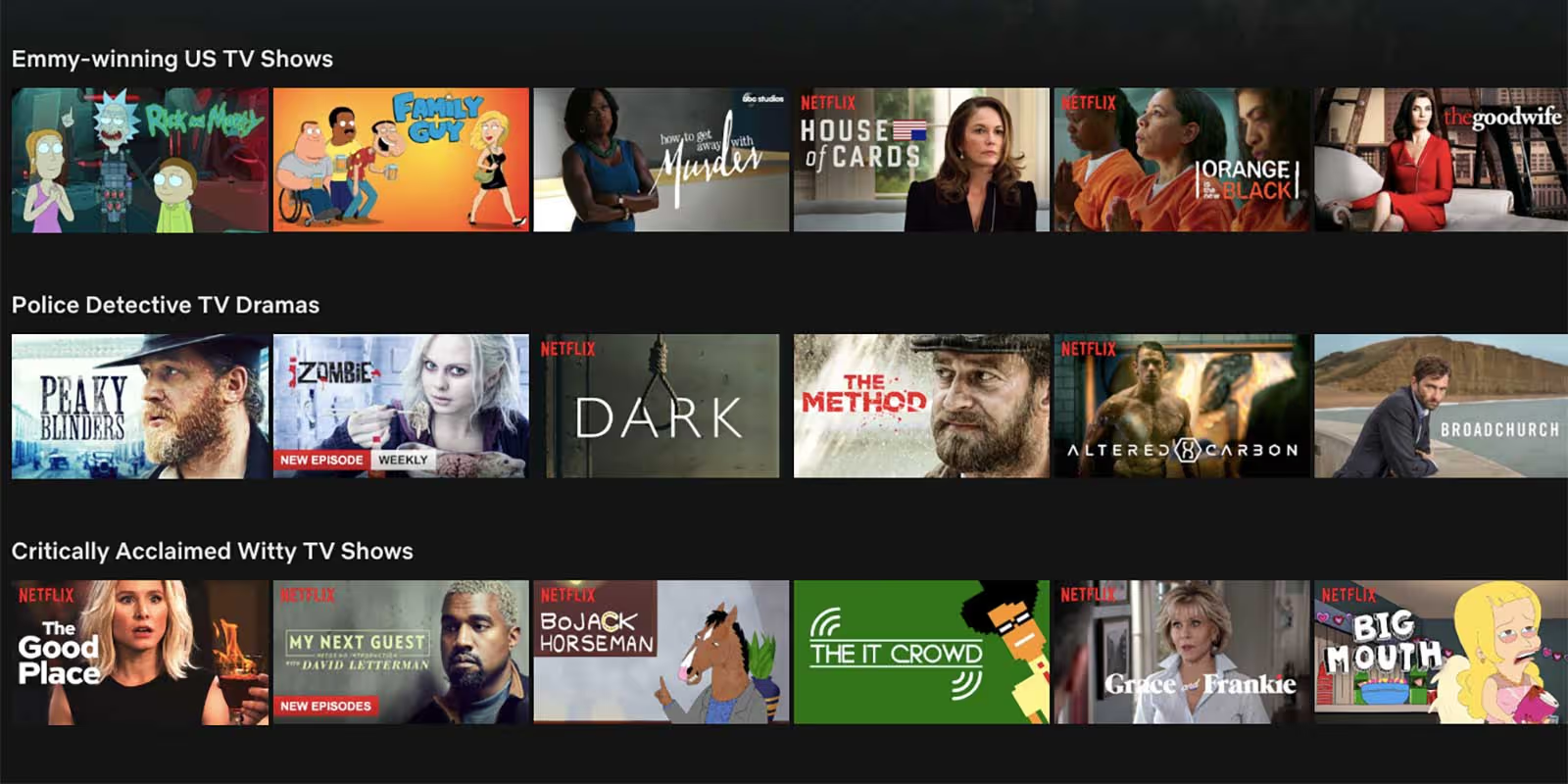

Ici, l’objectif est de guider l’utilisateur et de présenter une vaste sélection de produits ou services de manière organisée, structurée, priorisée, voire personnalisée. Netflix est la championne du monde de la structuration d’un choix. Vous devez prendre UNE décision parmi des milliers de possibilités. Grâce à des algorithmes complexes et plutôt bien renseignés, Netflix va vous proposer tel ou tel programme, selon qu’il est « choisi pour vous », dans le TOP10 au Canada ou bien encore fraichement débarqué dans le service de streaming. Il faut savoir que ces recommandations dépendent évidemment de votre historique de visionnement (Netflix sait si vous avez regardé telle ou telle série, si vous l’avez regardée d’un coup, ou au contraire si vous l’avez abandonnée à tel épisode), mais aussi en fonction du moment de la journée, de l’endroit où vous vous trouvez, et même de l’appareil sur lequel vous la regardez. Bref, c’est le comportement qu’on mesure, et le tout est comparé à des usagers similaires, afin de prédire vos goûts, et vos attentes.

Le but de ce nudge est de fournir à l’usager un retour d'information sur le comportement pour encourager le changement. Par exemple, montrer aux gens combien d'énergie ils consomment par rapport à leurs voisins pour les encourager à économiser. Les fontaines d’eau qui vous incitent à remplir votre bouteille et qui annoncent « X bouteilles sauvées » , ou des panneaux qui vous "remercient" d'avoir respecté la vitesse permise dans les rues, avec un petit bonhomme sourire.

Le but est ici d'utiliser un système de récompense/sanction pour influencer le comportement. Par exemple, offrir des réductions sur l'assurance-santé pour ceux qui font de l'exercice régulièrement.

L'idée est de créer un lien émotif pour pousser à l'action. Une étude menée par l'Université de Stanford a montré que l'utilisation d'images de bébés dans les lettres de rappel pour les vaccinations incitait les parents à faire vacciner leurs enfants❸. On peut aussi vouloir créer un choc émotif. Pensez aux photos terribles sur les paquets de cigarettes. C'est également un nudge affectif, mais à l'envers.

Le concept est d'indiquer à l'usager qu'en posant tel geste, il va se conformer à la norme. C'est en général une confirmation rassurante d'appartenance à un groupe social : le fameux "tout le monde le fait". Par exemple, une étude menée par l'Université de Californie a montré que l'affichage de messages indiquant que la majorité des clients d'un hôtel réutilisent leur serviette incitait les clients à réutiliser les leurs❹.

Comme son nom l'indique, il s'agit ici de simplifier les choses pour aider l'usager à prendre la bonne décision. Une étude menée par l'Université de Chicago a montré que la simplification du formulaire de demande de bourse incitait davantage d'étudiants à postuler.❹

Ici, il s'agit de provoquer l'action en proposant l'option la plus proche des besoins (ou désirs) de l'usager. Une étude menée par l'Université de Stanford a montré que la personnalisation des messages de rappel pour les rendez-vous médicaux incitait davantage de patients à se présenter à leur rendez-vous.

L'idée est simplement de rendre une action plus ludique qu'à l'habitude. Volkswagen a signé une campagne appelée "Fun Theory" dans le métro de Stockholm. Elle invitait les passants à utiliser les escaliers "ordinaires" plutôt que les escaliers roulants. Pour ce faire, les marches ont été transformées en piano géant. Ce nudge aurait entrainé une augmentation de 66% de l’utilisation des escaliers❺.

Il existe de multiples usages des nudges, notamment en ce qui concerne l'influence et la politique. Nous avons même écrit un article à ce sujet. Il convient de faire preuve de mesure, de prudence et d'intégrité quand vient le temps de faciliter la vie des usagers, car la manipulation n'est pas loin.

Alors, à vous de jouer, mais attention! Vous jouez avec l'esprit des usagers, donc avec le feu, et l'éthique. Utilisez les coups de pouce en gardant cela à l'esprit, et dans son intention originelle : vous ne devez pas les utiliser contre les gens, mais dans leur intérêt.