Steven J. Spear et Gene Kim sont des experts reconnus dans les domaines de la gestion et de l'innovation organisationnelle. Steven J. Spear, professeur au MIT Sloan School of Management, est un spécialiste des systèmes complexes et du lean management. Il est notamment l'auteur de The High-Velocity Edge, un ouvrage qui explore comment certaines organisations réussissent à innover et à s'adapter plus rapidement que leurs concurrents. Gene Kim, quant à lui, est une figure centrale du mouvement DevOps. Il a co-écrit plusieurs livres influents dans ce domaine, dont The Phoenix Project et The Unicorn Project, qui mettent en lumière comment les pratiques technologiques modernes peuvent transformer les entreprises et accroître leur performance.

Leur nouvelle théorie repose sur trois concepts clés : la slowification, la simplification et l'amplification. Voyons comment on peut l'appliquer dans notre quotidien, dans un contexte imprévisible et complexe.

La zone de danger : comprendre les défis de la complexité

La "zone de danger", selon Spear et Kim, représente les situations où les organisations font face à une grande complexité, des facteurs interconnectés, et des décisions rapides avec des enjeux élevés. C'est un environnement où les problèmes sont difficiles à identifier car ils sont souvent cachés, et où l'absence d'itérations ou d'opportunités de correction conduit à des risques élevés d'échec catastrophique.

Par exemple, le scandale des émissions de Volkswagen en 2015 montre à quel point les entreprises peuvent tomber dans la zone de danger. La manipulation des tests d'émissions dans le but de répondre rapidement aux attentes réglementaires a impliqué de nombreuses parties prenantes dans un système très complexe. L'accélération sans itérations possibles a conduit à une crise qui a coûté à l'entreprise plusieurs milliards de dollars en amendes, en plus d'endommager gravement sa réputation mondiale. La zone de danger, ici, est caractérisée par des décisions rapides, mal pensées, sans possibilité de retour en arrière.

La simplification : rendre les systèmes plus intelligibles

La simplification est la première clé pour sortir de la zone de danger. En rendant les processus plus compréhensibles et contrôlables, les leaders peuvent gérer la complexité de manière proactive. Simplifier signifie réduire le nombre de variables à surveiller et permettre aux équipes d'itérer sur leurs actions. Cela ne signifie pas éliminer la complexité, mais la rendre gérable.

Un exemple classique de simplification réussie se trouve dans l'industrie aéronautique. Airbus, lors du développement de l'A350, a fait face à des défis technologiques complexes avec un grand nombre de nouveaux matériaux et systèmes. En simplifiant les processus de fabrication, en segmentant le développement en phases itératives, et en adoptant des méthodologies agiles, Airbus a pu gérer les risques potentiels liés à la complexité. Résultat : une réduction des coûts et des délais, et un avion qui a su concurrencer efficacement Boeing. La simplification a permis de rendre visibles les problèmes et de les traiter avant qu'ils ne deviennent incontrôlables.

Slowification : ralentir pour mieux contrôler

La slowification, un terme emprunté à Spear et Kim, propose une approche radicalement différente de la manière dont les entreprises affrontent la pression. Ralentir le rythme des décisions permet aux organisations de mieux comprendre leur environnement, d'explorer plusieurs options et de détecter plus facilement les problèmes sous-jacents.

Prenons l'exemple de Toyota, un pionnier du lean management. Toyota a intégré la slowification dans sa chaîne de production en instaurant le principe du "Jidoka", qui permet aux travailleurs d'arrêter la ligne de production en cas de problème. Ce ralentissement instantané permet d'identifier et de résoudre les problèmes au moment où ils se produisent, évitant ainsi des erreurs massives coûteuses en aval. En intégrant des mécanismes de slowification, Toyota a pu rester leader dans un secteur ultra compétitif et complexe tout en minimisant les risques.

Dans un autre domaine, Netflix a également utilisé la slowification pour sa stratégie de lancement de contenu. Plutôt que de suivre les modèles traditionnels de diffusion, l'entreprise a opté pour des tests itératifs à petite échelle, observant attentivement les comportements des utilisateurs avant de généraliser ses innovations. Cette stratégie a permis à Netflix d'éviter les investissements massifs dans des projets voués à l'échec, tout en ajustant en temps réel sa programmation et ses développements technologiques.

Amplification : faire résonner les bonnes décisions

Enfin, l'amplification permet de maximiser les efforts et de faire grandir l'impact des décisions prises. Amplifier, dans ce contexte, signifie répéter ce qui fonctionne, augmenter la portée des initiatives positives, et s'assurer que les processus simplifiés et les retours issus de la slowification sont pleinement exploités.

Amazon est un bon exemple d'une entreprise ayant utilisé l'amplification pour son modèle logistique. En 2005, Amazon lance le programme Prime, une initiative qui repose sur la simplification du modèle de livraison avec une approche "slowifiée", permettant à l'entreprise de mieux contrôler ses flux logistiques. Après avoir testé le concept dans certaines régions et observé les résultats, Amazon a amplifié cette initiative à l'échelle mondiale. Ce modèle de livraison rapide a ensuite été étendu à de nouveaux services tels que la livraison de produits alimentaires avec Amazon Fresh.

Un autre exemple d'amplification réussie se trouve dans la stratégie de la société Tesla. En commençant par produire des véhicules électriques haut de gamme en faible volume avec la Model S, Tesla a lentement perfectionné sa technologie et ses processus de production. Une fois maîtrisés, Tesla a amplifié son impact en élargissant son offre à des modèles plus abordables comme la Model 3, augmentant ainsi son empreinte sur le marché mondial des véhicules électriques. Chaque étape de simplification et de slowification a permis une amplification massive des résultats sur les marchés internationaux.

Les bénéfices de la transition vers la zone de succès

Le passage de la zone de danger à la zone de succès n'est pas un processus instantané. Il nécessite de revoir la manière dont une organisation fait face aux pressions externes et aux complexités croissantes. En suivant une approche basée sur la simplification, la slowification et l'amplification, les organisations peuvent réduire les risques, améliorer leurs performances et minimiser les coûts d'échec.

Dans leur livre, Spear et Kim soulignent que ces principes ne s'appliquent pas uniquement aux grandes entreprises mais à toute organisation qui fait face à des défis complexes. En prenant des mesures pour ralentir le processus décisionnel, les leaders peuvent aider leurs équipes à mieux comprendre les problèmes, à itérer sur les solutions, et à amplifier les pratiques qui fonctionnent, menant ainsi à des environnements plus stables et prévisibles.

Mort et naissance.

Nous sommes le 30 juin 2003, à Caro, une petite ville du Michigan. Un avion ultraléger décolle de l'aéroport de Tuscola. Aux commandes, Joseph P. Overton, 43 ans, vice-président du Mackinac Center for Public Policy. L'appareil s'écrase quelques secondes après le décollage. Overton décède sur place.

Trois mois après ses noces, le jeune libertarien venait de mourir sans savoir que son nom allait bientôt baptiser une des théories les plus sulfureuses de la gestion politique. C'est son collègue Joseph Lehman qui reconstituera ses idées après sa mort, à partir de notes et de conversations. La fenêtre d'Overton est une œuvre posthume.

L'idée centrale du libertarianisme, c'est la liberté individuelle absolue et le libre marché sans entraves. Le Mackinac Center est un puissant think tank libertarien. Le groupe milite contre les syndicats, pour la privatisation des services publics, contre la régulation économique. Du conservatisme économique américain pur jus et assumé. Si tout cela vous sonne une cloche, c'est normal.

Le conseiller de Trump, Steve Bannon, a largement décrit — publiquement et sans gêne — sa stratégie médiatique comme un usage délibéré de la "fenêtre d'Overton" : inonder l'espace public de positions extrêmes pour rendre le trumpisme raisonnable en comparaison. Des think tanks d'extrême droite européens ont publié des guides pratiques pour déplacer la fenêtre sur l'immigration, l'identité nationale, la remise en question des institutions démocratiques.

Comprendre la fenêtre d'Overton nous permet de mieux saisir la stratégie de communication des républicains depuis 2016. Mais elle nous permet aussi de comprendre une mécanique psychologique importante dans la gestion du changement et des perceptions. Comme on le sent déjà, la fenêtre d'Overton sent un peu la mort depuis sa naissance. Et ça va sentir mauvais tout au long du chemin. Mais il est parfois nécessaire de traverser des marécages boueux pour comprendre ce qui se cache de plus sombre dans l'esprit humain. Alors on se pince le nez, et on y va.

Ce que la fenêtre décrit vraiment

L'idée de base est simple. À tout moment, dans une société ou dans une organisation, il existe un ensemble d'idées, de propositions ou de comportements qui sont perçus comme acceptables. Pas nécessairement populaires, pas nécessairement bons — simplement dans le champ du possible. Tout ce qui se trouve hors de cette fenêtre est considéré comme trop radical, trop bizarre, trop risqué ou carrément impensable pour mériter une discussion sérieuse.

Cette fenêtre n'est pas fixe. Elle se déplace. Elle s'élargit ou se rétrécit. Et ce déplacement n'est pas le fruit du hasard : il est influencé par les discours, les événements, les crises, les précédents — et par la façon dont les idées sont introduites dans la conversation.

Overton a décrit six positions sur le spectre d'une idée. Impensable — L'idée est perçue comme choquante, immorale ou absurde. Même la mentionner sérieusement est risqué. Radicale — L'idée commence à circuler dans certains cercles, mais reste marginale et controversée. Acceptable — L'idée entre dans le débat sérieux. Des gens raisonnables commencent à la défendre. Sensée — L'idée est perçue comme une option viable parmi d'autres. Courante — L'idée est largement adoptée, voire attendue. Politique établie — L'idée est devenue la norme. Elle est institutionnalisée. On ne la remet plus en question.

Ce qui est crucial à comprendre : une idée ne saute pas directement de l'impensable au courant dominant. Elle traverse ces étapes l'une après l'autre, à des vitesses variables, sous l'influence de multiples facteurs. Et parfois — on y reviendra — une crise fracasse la vitre et brûle les étapes. Ce n'est pas la même chose.

Prenons un exemple. Et si on mangeait des chats?

J'ai délibérément choisi un exemple impensable, inconfortable, dégeulasse — et j'embrasse Carmen, mon petit amour de chat au passage. Mais je voulais un exemple extrême. C'est l'idée. C'est exactement ce dont la fenêtre d'Overton a besoin pour fonctionner. Donc… Et si on mangeait des chats?

Impensable. En Occident, l'idée est impensable. Pas illégale dans la plupart des pays — juste socialement inadmissible. Exactement là où était la viande chevaline il y a deux générations. Aujourd'hui, le cheval est au menu des brasseries françaises sans que personne ne s'indigne. Quelqu'un a déplacé la fenêtre. Revenons au chat.

Radicale. On commence par créer les conditions d'un débat légitime. Des chercheurs publient des données sur les traditions culinaires félines en Asie du Sud-Est — elles existent. Des philosophes posent une question gênante : si on mange des cochons, qui sont cognitivement comparables aux chats, pourquoi pas des chats? L'idée est encore choquante. Mais elle est maintenant dans la conversation. C'est suffisant pour l'instant.

Acceptable. Viennent ensuite les arguments sérieux. L'empreinte carbone d'un chat de compagnie est réelle et documentée. La surpopulation féline dans les villes nord-américaines est un problème coûteux. Des millions de chats sont euthanasiés chaque année dans des refuges. L'argument de la valorisation d'une ressource déjà disponible n'est pas absurde — il est simplement inaudible. Pour l'instant.

Sensée. Puis les précédents. La Suisse a légalement autorisé la consommation de viande de chat depuis 2022 (ceci n'est pas une blague et… ça change de la raclette 😆). Ce n'est pas anecdotique : ça suffit à faire passer l'idée de radicale à acceptable, étudiable, cartographiable.

Courante. Le basculement se produit quand le contexte change. Une pénurie alimentaire. Une taxe carbone sur la viande bovine. Un scandale sanitaire dans l'industrie porcine. Les arguments qui dormaient dans les marges deviennent soudainement audibles. Des chefs expérimentent. Les médias couvrent sans rigoler.

Politique établie. C'est exactement la mécanique qui a rendu les insectes comestibles acceptables en dix ans. En 2010, manger des grillons en Occident était une blague. En 2023, les farines d'insectes sont en supermarché européen. Personne n'a changé d'avis du jour au lendemain. La fenêtre s'est simplement déplacée — argument par argument, précédent par précédent.

Le chat, c'est peut-être dans vingt ans. Ou jamais. Mais le mécanisme, lui, est déjà à l'œuvre sur des idées que vous défendez en ce moment dans votre organisation — et que vos collègues trouvent tout aussi impensables.

Pourquoi c'est un outil de lecture de l'actualité

Avant même de penser à utiliser la fenêtre d'Overton comme outil de gestion, il faut apprendre à la lire. Et c'est là que son utilité est la plus immédiate, la moins risquée, et la plus précieuse.

Regardez un enjeu d'actualité — la semaine de quatre jours, la transparence salariale, le droit à la déconnexion, l'intelligence artificielle dans les processus RH — et posez-vous la question : où est-on sur ce spectre, dans mon secteur, dans mon organisation, dans ma culture?

Cette lecture vous donne une information stratégique fondamentale : à quelle étape de la fenêtre se situe l'idée que vous voulez faire avancer? C'est cette étape qui détermine votre approche. Une idée ne se défend pas de la même façon selon qu'elle est encore impensable ou déjà largement sensée.

Attention aussi aux fenêtres fracassées. Une crise majeure ne déplace pas la fenêtre : elle la brise. Le confinement de 2020 en est l'exemple parfait. En février, interdire aux gens de sortir de chez eux, de voir leur famille, de tenir leur commerce ouvert était proprement impensable dans une démocratie occidentale. En mars, c'était la loi. La distanciation sociale — ne pas s'approcher à moins de deux mètres d'un inconnu, ne pas serrer la main, ne pas embrasser — était devenue une obligation morale et légale en l'espace de quelques jours. Pas parce que les esprits avaient évolué. Parce que les circonstances avaient fracassé la vitre. Et on a vu ce qui s'est passé ensuite : les théories du complot, la résistance aux masques, la défiance vaccinale, la nostalgie d'un avant que certains n'ont jamais vraiment quitté. La fenêtre avait été brisée, pas ouverte. Ce type de changement brutal laisse des traces profondes. Les gestionnaires qui confondent «fenêtre fracassée» et «fenêtre déplacée» se retrouvent souvent à gérer un changement que personne n'a vraiment compris — et encore moins accepté.

Ce que ça change pour un communicateur

Un communicateur interne, un responsable RP ou un directeur des affaires publiques vit en permanence dans cette tension : comment introduire une idée qui n'est pas encore acceptable, sans provoquer un rejet immédiat?

Pensez simplement au retour au bureau. Le problème n'était jamais le nombre de jours. C'était le fait d'avoir mal lu où en était la fenêtre — et d'avoir tenté de forcer une porte qui n'était pas prête à s'ouvrir. La réponse de la fenêtre d'Overton est contre-intuitive : il ne faut pas commencer par l'idée que vous voulez faire adopter. Il faut d'abord cartographier où en est la conversation.

Impensable. Votre travail n'est pas de défendre l'idée. C'est de créer les conditions pour qu'elle devienne un sujet de débat légitime. Des chercheurs qui publient, des cas étrangers qui circulent, des événements qui ouvrent des brèches. En 2018, proposer de supprimer les bureaux fixes et de ne plus jamais revenir au bureau était une hérésie managériale. Quelques articles sur le travail nomade dans les entreprises scandinaves ont commencé à faire circuler l'idée.

Radicale. Votre travail est de légitimer l'idée. Pas nécessairement de la défendre vous-même — montrer que des gens sérieux, dans des contextes comparables, la défendent avec des arguments solides. Le but : faire passer l'idée de «bizarre» à «discutable». En 2019, quelques grandes entreprises technologiques annoncent des politiques de télétravail permanent. L'idée devient cartographiable.

Acceptable. Vous pouvez entrer dans le débat directement. Arguments, données, expériences pilotes. La résistance est encore présente, mais elle n'est plus viscérale. C'est là où se trouve aujourd'hui le débat sur le retour au bureau dans la plupart des organisations — un terrain négocié, pas encore stabilisé.

Courante. Votre rôle change complètement. Il ne s'agit plus de persuader, mais d'accompagner la mise en œuvre. Les résistances qui subsistent sont individuelles, pas collectives. C'est le territoire de la gestion de changement classique.

L'effet d'ancrage et ses limites

Une des tactiques les plus souvent associées à la fenêtre d'Overton, c'est celle de l'ancrage extrême : pour rendre une idée acceptable, on commence par en proposer une beaucoup plus radicale, de sorte que l'idée visée semble soudainement raisonnable en comparaison.

En psychologie comportementale, cet effet est bien documenté. Daniel Kahneman a montré comment la première proposition dans une négociation influence profondément toutes les évaluations qui suivent. Le principe semble séduisant appliqué à la gestion de changement — et il fonctionne réellement sur la perception immédiate.

Mais attention : efficace à court terme, potentiellement destructeur à moyen terme. Si la tactique est perçue — et elle l'est souvent —, elle détruit la confiance et crédibilise les voix qui dénoncent la manipulation. Dans un contexte organisationnel, perdre la confiance de vos équipes coûte infiniment plus cher que ce que vous avez gagné tactiquement.

L'ancrage peut être utile pour ouvrir une conversation, pas pour conclure une négociation.

Le vrai travail : déplacer la fenêtre, pas forcer la porte

Ce que la fenêtre d'Overton enseigne aux gestionnaires les plus habiles, c'est que le changement durable ne s'impose pas — il se prépare. Et cette préparation est un travail de communication qui s'étale dans le temps.

Les précédents internes. Rien ne légitime une idée comme le fait qu'elle ait déjà été testée quelque part dans votre organisation. Une expérience pilote réussie dans un département devient un argument béton pour l'ensemble de l'organisation. Ce n'est plus une idée abstraite : c'est quelque chose qui s'est fait ici.

Les pairs influents. Dans toute organisation, certaines voix ont plus de poids que d'autres pour déplacer la fenêtre. Ce ne sont pas nécessairement les plus hauts dans la hiérarchie — souvent, ce sont les personnes les plus respectées par leurs collègues. Les identifier et les engager tôt dans la réflexion est une des stratégies les plus puissantes pour préparer le terrain.

Le langage. Les idées progressent souvent en changeant de nom. Ce qui s'appelait «contrôle» est devenu «imputabilité». Ce qui s'appelait «réduction de personnel» est devenu «optimisation de la structure». Le choix du vocabulaire n'est pas de la manipulation : c'est de la communication stratégique. Les mots signalent l'intention, et l'intention influence la réception.

Les événements extérieurs. Les gestionnaires intelligents regardent le monde non pas comme une distraction, mais comme un signal : quels événements sont en train de déplacer la fenêtre dans votre secteur? Quelles idées que vous défendiez depuis des années viennent soudainement d'entrer dans le champ de l'acceptable?

L'avertissement éthique qu'il faut prendre au sérieux

La question éthique est simple : cherchez-vous à déplacer la fenêtre parce que le changement est dans l'intérêt des personnes concernées? Ou cherchez-vous à contourner leur jugement?

Rappelons que cet outil est né dans un think tank libertarien, et qu'il a été perfectionné par l'extrême droite américaine et européenne pour normaliser des idées qui n'auraient jamais survécu à un débat honnête. La mécanique est puissante. Préparer le terrain pour qu'une idée soit reçue équitablement, c'est de la communication stratégique. L'utiliser pour faire adopter quelque chose que les gens n'auraient pas voulu avec toute l'information, c'est exactement ce que Bannon a fait. La ligne est parfois mince. Et dans une organisation, vos équipes la sentent avant même de pouvoir la nommer.

Nous l'avons vu dans un précédent article, les nudges — coups de pouce — sont un moyen puissant de contrôle du comportement des humains. Ça paraît gros dit comme ça, mais c'est tout petit, au contraire. Un nudge est une incitation au passage à l'acte quasiment imperceptible, et qui repose sur une prémisse universelle : les humains sont paresseux.

L'idée de Thaler et Sunstein (les papas des nudges), c'est qu'il est préférable d'aider l'usager à prendre la bonne décision — éthiquement, c'est aussi la décision que ce dernier aurait prise sans nous, mais il a besoin d'un coup de pouce pour se lancer. Nous avons vu qu'il existait plusieurs types de nudges et qu'ils étaient souvent utilisés dans la santé, dans les services publics, mais aussi en économie (dans les services bancaires, les levées de fonds, etc.) Bref, aucun domaine n'échappe aux nudges. Pourquoi un tel succès? Parce que la plupart du temps, un nudge ne coûte (presque) rien. Tester un nudge est donc peu risqué et très tentant... Il était donc tout naturel que la politique s'empare de cet outil tactique puissant.

L'utilisation des nudges en politique est un terrain éthique miné, qu'il s'agit d'observer avec un regard critique. Un article du Guardian signé Andrew Sparrow➊ sur le conservateur David Cameron, architecte conservateur du Brexit — et de la crise économique traversée par la Grande-Bretagne depuis — a révélé l'importance des nudges dans les décisions politiques. En quelques définitions (parfois un peu cyniques), Sparrow récapitule le travail de Thaler et Sunstein en se lançant dans un exercice que je n'ai pas hésité à personnaliser.

Pourquoi vous intéresser aux nudges?

Parce que les mécanismes des nudges peuvent vous aider à comprendre bien des choses en matière de psychologie comportementale. Associé à l'économie, cette discipline s'appelle l'économie comportementale. Elle est riche d'enseignement et évite les raccourcis souvent pris par les organisations, qui se terminent en voie sans issue. Normal : l'humain est complexe... mais passionnant. Cela va vous aider à mieux comprendre la complexité de vos employés, de vos clients, des citoyens de votre municipalité ou de votre province. Mieux comprendre la mécanique de ces coups de pouce, c'est vous préparer à être de meilleurs stratèges du changement.

Les racines neuroscientifiques du nudge

Daniel Kahneman avait lui-même pavé la voie de la psychologie comportementale en remportant le prix Nobel d'économie en 2002, cinq ans avant Thaler. Ils ont d'ailleurs collaboré, et les recherches de Kahneman expliquent bien des choses➋ . Il a démontré que le cerveau humain fonctionnait à deux vitesses. Le système 1, rapide et intuitif. Le système 2, rationnel, délibéré. Biologiquement, le système 1 ne demande pas beaucoup d'énergie. Le système 2 est plus énergivore, donc plus fatigant. Le nudge est donc un stimulus qui va privilégier le système 1. Il va provoquer une action rapide, qui demande peu d'effort... et notre cerveau adore ça!

→ Misez sur l'instinct. En politique, mieux vaut être sympathique et rassurant que stratégique et brillant. Pourquoi? Parce que la plupart des électeurs ne se rendent pas jusque-là dans leurs réflexions. Cela explique beaucoup de scrutins de ces dernières années, partout dans le monde. Si vous voulez réussir, pensez sans cesse au Système 1. Il faut parler à l'instinct des gens.

Architecte du choix

Deuxième idée de Thaler et Sunstein, il existe toujours un architecte du choix, assumé ou pas. La personne qui va écrire le menu du jour sur l'ardoise au restaurant, celui ou celle qui va décider de l'emplacement des étals à l'épicerie, ou bien les gens qui ont choisi les photos sur les murs de votre coiffeur... Il y a toujours quelqu'un qui a décidé quelque chose à votre place... et c'est bien normal. L'idée est d'assumer ce rôle et d'en profiter pour influencer ce choix. L'économiste prend l'exemple d'une cafétéria, où l'on peut décider de mettre les salades avant les burgers pour influencer le choix des gourmands, qui savent que la salade est un meilleur choix. En politique, on pourrait parler de "manipuler les questions" si on voulait être cynique ou brutal. Mais si les politiciens sont aussi des architectes des choix, certains d'entre eux ne s'en rendent probablement pas compte. Thaler et Sunstein pensent même que s'ils comprenaient cela, ils feraient mieux leur travail.

Depuis la naissance des nudges, les cabinets-conseils en politique n'ont pas lésiné sur l'usage intensif des coups de pouce pour demander aux citoyennes et citoyens de faire... la bonne chose. Le premier ministre britannique David Cameron, le président Obama, le président Macron ont tous créé des cellules spécialisées dans les nudges, les nudges units➍➎➏. Il s'agit d'un groupe de spécialistes des biais psychologiques. Ces experts font des recommandations de nudges à leurs clients (ici des cabinets présidentiels ou ministériels), afin d'atteindre des objectifs définis. Avec un regard critique, on peut parler de manipulation de masse. Avec un regard pragmatique, il s'agit d'assumer que tout choix est l'oeuvre d'un architecte. Et lui convient aussi d'assumer ce rôle d'architecte.

Le Canada n'est pas en reste. Le gouvernement fédéral s'est doté d'une nudges unit pour gérer la crise du COVID❼. Au Québec, les journalistes se sont peu penchés sur la question, même si on a pu observer les nudges dans la promotion de bonnes habitudes environnementales❽. Bref, les nudges sont vraiment partout!

Paternalisme libéral?!

Par définition, le nudge — l'architecte du choix qui a choisi le nudge — est paternaliste. C'est un terme qu'assument Thaler et Sunstein. L'idée, c'est d'améliorer la vie des gens... même contre leur gré. L'expression originale est "Libertarian paternalism", ce qui ressemble à un oxymore géant. On pourrait la traduire par paternalisme bienveillant, libéral, libertarien (ultra-libéral), ou intrusif et condescendant selon qu'on soit pour ou contre. La cause n'est pas entendue et fait encore débat entre les philosophes et les économistes.

Econs et Humains

Les économistes (et certains décideurs politiques) ont tendance à travailler sur l'hypothèse que les gens agissent rationnellement et qu'ils font toujours ce qui est le mieux pour eux. Cette hypothèse est fausse. Thaler et Sunstein appellent les gens qui se comportent réellement de cette manière des Econs❼, des sortes de "robots comportementaux" agissant de la bonne manière et toujours de la même façon. Thaler et Sunstein ont démontré que "les vraies personnes" n'agissent pas toujours de manière rationnelle. Elles sont sans cesse influencées par des biais et des émotions qui les empêchent d'être conformes à une norme imaginée par les instituts de sondage, les chercheurs, les économistes et les politiciens. On appelle ces gens imparfaits et irrationnels... des humains.

Statu quo et conservatisme.

Thaler et Sunstein ont démontré que l'humain (en tant qu'individu) n'aime pas le changement, et qu'il a tendance à accepter ce qui est proposé. Ce biais de statu quo s'applique aussi collectivement. On parle alors de conservatisme collectif.

Effet de simple mesure

Dernier fait intéressant, lorsque les gens sont interrogés sur ce qu'ils ont l'intention de faire dans une enquête, ils sont plus susceptibles de le faire. Si un partisan vient cogner à votre porte, ou si un sondeur vous appelle pour savoir si vous allez voter demain... La probabilité que vous alliez vraiment voter augmente de 25%. Les instituts de sondages ont de beaux jours devant eux!

Vers les "nudges plus"

Des petits malins planchent déjà sur la suite de la saga. En 2021, Cambridge University Press a publié un article➓ sur ces supers coups de pouce, les nudges plus qui incorporent un élément de réflexion dans le nudge, une sorte de nudge "System 1 + 2", donc. Ce sont des études qui valent la peine qu'on surveille leur évolution, même si cette réflexion semble un peu contre-intuitive au regard de la pensée originelle de Thaler et Sunstein.

Soyons honnêtes, on a tous déjà quitté le bureau à 16h30 au lieu de 17h. On respecte généralement les règles, mais pas toujours. Certains ont peur des sanctions ou agissent par principe, d’autres suivent le groupe, et quelques-uns ignorent les règles, peu importe les conséquences. Ce n’est pas nous qui le disons, mais bien Simon Gächter, Lucas Molleman et Daniele Nosenzo, de brillants chercheurs en sciences comportementales et économiques.

Le modèle C(R,I,S,P)

Dans l’article « Why people follow rules », Gächter, Molleman et Nosenzo nous présentent la conformité aux règles (C) comme la fonction mathématique: C=ƒ(R;I;S;P). Autrement dit, respecter une règle dépend de plusieurs variables. Voici comment ils les décortiquent :

- Le respect intrinsèque des règles (R) : est-ce que je respecte la règle par principe ?

- Les incitations extrinsèques (I) : quelles sont les sanctions et les récompenses associées au respect ?

- Les attentes sociales (S) : qu’est-ce que les autres font et attendent de moi ?

- Les préférences sociales (P) : est-ce que ça protège ou nuit au bien collectif ?

Pour rendre tout cela plus concret, nous avons vulgarisé l’étude en trois effets que vous avez sûrement dû déjà observer : l’effet mouton, l’effet pomme pourrie et l’effet maternel. Trois images simples pour comprendre pourquoi on suit les règles… ou pas!

L’effet du mouton

L’effet du mouton fait référence aux « attentes sociales » du modèle CRISP. C’est-à-dire l’influence des autres sur nos décisions, surtout lorsqu’il est question de respecter une règle. Ce phénomène n’a rien de nouveau. Déjà en 330 avant J.-C., Aristote affirmait que l’humain est un « animal social et politique ». Nous vivons en groupe, nous partageons des normes, et nous nous ajustons les uns aux autres. En d’autres termes, comme un troupeau, nous captons les mouvements avant de faire le nôtre.

Environ 30 % des individus adaptent leur comportement à celui du groupe. Si l’heure officielle de départ est 17 h, mais que tout le monde quitte à 17 h 30, plusieurs vont suivre. Formellement, la règle n’a pas changé, mais la norme informelle, elle, s’est déplacée.

Mais attention : suivre le groupe n’explique pas tout. Parfois, ce n’est pas le troupeau qui entraîne, c’est une seule pomme qui abîme tout le panier. Parlons justement de l’effet de la « pomme pourrie ».

L’effet de la « pomme pourrie »

Toujours dans la logique des attentes sociales, mais sous l’angle inverse : ici, ce n’est pas le groupe qui nous élève, c’est un individu qui nous tire vers le bas, comme une pomme pourrie qui contamine ses semblables!

L’expression « a rotten apple quickly infects its neighbor » remonte au 14ᵉ siècle. Benjamin Franklin la popularise ensuite au 18ᵉ. L’idée traverse le temps, mais ce n’est qu’en 2007 que le chercheur Will Felps la valide scientifiquement : la présence d’un seul individu négatif, déviant ou non coopératif peut détériorer la dynamique et la performance d’un groupe entier.

Concrètement, voir quelqu’un enfreindre une règle ne nous fait pas immédiatement changer d’avis. On continue de croire que la règle est valable, mais la transgression devient un peu plus acceptable. Si un collègue part à 16 h 30 chaque jour et que d’autres commencent à le faire, vous allez commencer à penser que « ce n’est pas si grave » de faire la même chose. Encore une fois, la règle n’a pas changé, elle s’est érodée!

L’effet « Maternel »

Avant d’aborder le thème des sanctions, voyons d’abord un levier tout aussi important : celui des préférences sociales dans le modèle CRISP.

Les règles existent souvent pour protéger autrui. Lorsqu’on comprend qu’une infraction nuit aux autres, leur respect augmente de 55 % à… 61 %! Autrement dit, une règle est mieux suivie lorsqu’elle a du sens pour le collectif.

C’est ce qu’on appelle l’effet « maternel », ou mama bear syndrome. On respecte la règle non par peur ni par conformisme, mais par instinct de protection.

Si vos collègues travaillent tard sur un dossier important, vous serez naturellement porté à rester passer les 17 heures pour les aider. Pas parce qu’on vous l’impose, mais parce que quelqu’un en bénéficiera.

Les sanctions sont-elles vraiment efficaces?

S’il est vrai que les attentes sociales nous influencent, les sanctions jouent elles aussi un rôle. C’est la variable incitations extrinsèques (I) du modèle CRISP. Mais attention : toutes les sanctions n’augmentent pas automatiquement l’obéissance d’un groupe. Certaines peuvent même produire l’effet inverse.

Crédibilité de la sanction faible

Lorsque la probabilité d’être sanctionné est faible, la conformité augmente à peine : de 61 % à 62 %. Autrement dit, la simple menace a peu d’effet si elle n’est pas suivie d’actions concrètes. Par exemple, si la direction rappelle que l’heure de départ est fixée à 17 h, mais que les contrôles sont rares et les conséquences inexistantes, les départs anticipés continueront. La règle existe, mais elle manque de crédibilité.

Crédibilité de la sanction forte

À l’inverse, lorsque la sanction est hautement probable, l’obéissance inconditionnelle passe de 26 % à 57 %. Ainsi, si la direction inscrit une note au dossier dans la majorité des cas de départs précoces, le respect de l’heure officielle augmente. La différence tient à un élément clé : la sanction n’est plus théorique, elle est perçue comme réelle et crédible.

Sanctions ou non?

Les sanctions ne devraient jamais être le réflexe automatique. Oui, elles peuvent dissuader, mais seulement si elles sont proportionnées et crédibles. Pour des règles du quotidien comme l’heure de départ, le sens est souvent plus puissant que la menace.

Ce qu’il faut faire? Expliquer le « pourquoi » derrière la règle! Si un gestionnaire explique qu’il faut rester jusqu’à 17 h pour assurer la collaboration avec l’équipe en Australie, la règle cesse d’être arbitraire. Elle devient logique. Quand une règle fait sens, on est beaucoup plus enclin à la respecter.

Le respect des règles, quoiqu’il arrive

Bonne nouvelle : plus de la moitié des gens, entre 55 et 70 %, respectent les règles par principe, même en l’absence de sanction. Les chercheurs parlent ici de respect intrinsèque (R) dans le modèle CRISP. Alors pas de panique! Si vous changez l’heure officielle de départ à 18 h, une bonne partie de l’équipe attendra patiemment les six coups de 18 h avant de quitter. Mais puisque la norme au Québec reste 17 h, on ne vous le conseille pas!

Le grand culte du mouvement

Notre époque a sacralisé le changement. Être agile, être mobile, être en croissance, être en transformation — le vocabulaire de la modernité est entièrement bâti sur le verbe du mouvement. Stagner, plafonner, se figer, s'installer : voilà à l'inverse des verbes qui sentent la défaite. Le changement est devenu une vertu en soi, sans condition, sans destination.

J'avais déjà écrit là-dessus dans un article sur Demeure, l'essai du philosophe François-Xavier Bellamy. Sa thèse tient en une phrase : le mouvement ne vaut que s'il est observé d'un point fixe. La rivière ne s'écoule que parce que la rive est immobile. Galilée a remis la Terre en marche; depuis, nous courons. Mais nous courons sans savoir où. Bellamy appelle ça le progressisme sans destination.

Aujourd'hui, ce progressisme a un effet secondaire dont nous souffrons globalement toutes et tous dans nos organisations.

Change Fatigue

Longtemps considéré comme un simple jargon de consultant, le concept de « change fatigue » a acquis sa légitimité scientifique en 2011. Les chercheurs américains Jeremy Bernerth, Jack Walker et Stanley Harris en ont alors fait un concept rigoureux dans la revue de psychologie organisationnelle Work & Stress. Quinze ans plus tard, leur outil d'évaluation — la Change Fatigue Scale — fait toujours autorité.

Six questions, évaluées sur une échelle de 1 à 7. Si leur formulation précise demeure protégée par le droit d'auteur, on connait néanmoins les critères mesurés, que voici.

- Le détachement (le mode « bof ») : On ne se sent plus du tout concerné par l'avenir de la boîte. C'est l'indifférence qui s'installe.

- L'accord de façade : On dit oui et on hoche la tête en réunion pour avoir la paix, mais on n'y croit pas et on n'a aucune intention de l'appliquer.

- L'impression de subir : On a le sentiment de n'avoir aucun contrôle sur ce qui change. Les décisions tombent d'en haut, et on doit juste exécuter.

- L'épuisement total : On est vidé, mentalement et physiquement. On n'a plus le temps, plus l'énergie, ni le contrôle de ses journées pour encaisser un changement de plus.

Ces quatre dimensions, mises ensemble, dessinent un état distinct du burnout, qui s'installe quand les changements se succèdent sans qu'aucun ne soit jamais réellement digéré.

L'étude la plus éclairante pour les gestionnaires reste celle de Michiel de Vries, publiée en 2021 dans Public Money & Management. Le chercheur de l'université de Radboud a passé au crible les réorganisations répétées dans le secteur public néerlandais. Sa conclusion est contre-intuitive : la résistance au changement, qu'on attribue habituellement à des conflits d'intérêts ou à un désaccord sur les buts, vient en fait de la mémoire des réorganisations précédentes. Les employés qui ont vécu trop de changements aux effets concrets sur leur travail quotidien refusent le suivant — par sédimentation, davantage que par opposition.

Le problème n'est donc pas l'objet du changement à venir, mais le souvenir des changements passés. Les traces sont plus importantes que les promesses.

Le premier remède à la fatigue, c'est l'inventaire, la reconnaissance, ou la célébration du chemin parcouru et des changements accomplis par le passé. Il faut fermer le livre avant d'en ouvrir un nouveau.

Le problème n'est pas l'objet du changement à venir, mais le souvenir des changements passés.

Gaëtan Namouric

Les chiffres qui piquent

Gartner mesure désormais la fatigue du changement comme on mesure l'engagement ou la satisfaction client. Le portrait qu'en tirent les enquêtes récentes est sombre.

En 2016, 74% des employés se disaient disposés à soutenir un changement organisationnel. Six ans plus tard, ils ne sont plus que 43%. La moitié de l'envie envolée. En parallèle, l'employé moyen a vécu dix changements stratégiques planifiés dans la dernière année. Dix. Pas dix mises à jour de logiciel — dix changements de cap.C'EST ÉNORME!

Le chiffre étonne tellement qu'il mérite explication. L'enqête de Gartner s'est faite auprès de plus de 3 500 employés à travers le monde, et elle englobe tout ce qu'un travailleur typique est amené à absorber sur une année : restructurations d'équipes, fusions de départements, déménagements de locaux, nouvelles politiques RH, rebranding, changements de PDG ou de chefs immédiats, refontes de processus, repositionnements stratégiques, transformations digitales, déploiement de nouveaux outils technologiques. Soit un changement majeur tous les cinq ou six semaines. Ce qui laisse aux équipes à peu près six semaines pour comprendre, intégrer et appliquer le précédent avant que le suivant atterrisse sur leur écran. La moyenne historique, avant 2017, oscillait autour de deux ou trois changements par an. On a multiplié par quatre la cadence sans rallonger le temps disponible pour y répondre.

Côté gestionnaires, c'est pire encore. 41% des managers seulement sont prêts à modifier leurs propres comportements pour accompagner la transformation qu'on leur demande de porter. 90% des dirigeants RH considèrent que leurs gestionnaires n'aident plus leurs équipes à traverser la fatigue. Près des trois quarts s'estiment mal outillés pour piloter une transformation. Et le résultat tombe en cascade : selon une étude Gartner de juillet 2025 portant sur 2 850 employés, seules 32% des organisations atteignent ce qu'on appelle une adhésion saine au changement. 79% des employés ont une faible confiance dans la capacité de leur organisation à mener du changement de manière efficace.

En clair : les deux tiers des transformations foirent, plombées par le moral des gens… avant même qu'on ait tenté de comprendre leur but ou leur impact.

On est passé de deux changements par an à… dix!

Étude Gartner

Une fatigue qui varie avec l'âge

Une étude d’Eagle Hill Consulting publiée en février 2026 met en lumière une réalité frappante : face aux transformations de l'entreprise, les générations ne réagissent pas du tout de la même manière.

Prenons l'exemple d'un changement de processus internes :

- 70 % de la Gen Z estime que cela améliore l'entreprise.

- 45 % des Baby-Boomers partagent cet avis.

- 36 % de la Gen X seulement sont d'accord.

Le fossé se creuse encore plus sur la question du retour au bureau : à peine 3 % de la Gen X pensent que cela a fait du bien à l'organisation. De manière générale, les salariés plus âgés (Gen X et Boomers) se sentent beaucoup moins épaulés par leur employeur dans ces transitions que leurs jeunes collègues. On a creusé le sujet dans cet article sur le télétravail.

L'âge importe moins que le vécu

Attention toutefois à ne pas tomber dans le piège des clichés. Ces étiquettes (Boomers, X, Millennials, Z) relèvent souvent plus de l'horoscope que de la sociologie. Le vrai sujet ici n'est pas l'âge biologique, mais le nombre de transitions vécues au cours d'une carrière.

Un membre de la Gen X dans la cinquantaine a déjà traversé une quantité impressionnante de vagues : l'informatisation, l'arrivée d'Internet, le bug de l'an 2000, la crise de 2008, l'explosion des smartphones, le cloud, la pandémie, le télétravail, et aujourd'hui l'IA. Chaque fois, on lui a promis une « transformation décisive ». Souvent, il n'a vu passer que des modes coûteuses (comme le métavers). Cette mémoire est à double tranchant : elle aiguise le jugement, mais elle nourrit aussi le cynisme.

À l'inverse, la Gen Z n'a pas ce passif. Pour elle, le changement permanent est le décor de base, pas un événement. Son optimisme peut donc se lire de deux façons : comme une belle fraîcheur d'esprit, ou comme un manque de recul… Et lles deux visions sont justes.

Quatre nageurs face à la même vague

Dans une équipe de cinq personnes aujourd'hui, la diversité des vécus numériques est fascinante : Le Boomer a connu la fin du papier carbone. Le Gen X a installé le tout premier intranet. La Millennial a lancé la stratégie sur les réseaux sociaux. Le Gen Z utilise ChatGPT depuis le secondaire.

Annoncer un « nouveau virage stratégique » à cette équipe revient à confronter quatre nageurs à la même vague. Le Gen Z ressent le frisson de la nouveauté. Le Millennial y voit une routine classique, sans surprise. Le Gen X se dit qu'il a déjà vu ça cent fois. Le Boomer anticipe déjà la tempête suivante et calcule le temps qu'il lui reste à tenir le cap.

La vague, elle, est identique pour tout le monde. C'est la mémoire de chacun qui change la donne. Pour un manager, réussir une transformation ne demande pas de piloter un groupe uniforme, mais de savoir composer avec cette accumulation d'expériences. Attention cependant aux piège généraiton/âge/époque que nous avons déjà décrit dans cet article.

Révolution, vous dites?

Oui, notre époque vit une compression hallucinante de transformations. Mais… non, ce n'est pas la première fois. Si notre époque a inventé Internet et l'IA, la fin du XIXe siècle a été autrement plus productive !

On invente tour à tour le tramway électrique, la bicyclette moderne, l'automobile à moteur à explosion, les pneus à air, le métro souterrain et l'aviation. Pour ce qui est du confort domestique, on apprivoise l'électricité (quand même !), l'ampoule à incandescence, le ventilateur, le fer à repasser, le lave-vaisselle, l'aspirateur, la climatisation, la machine à laver, le réfrigérateur et le tube au néon. Les objets du quotidien, la mode et l'alimentation basculent eux aussi dans la modernité avec le stylo-plume, la bouteille thermos, l'appareil photo de poche, le trombone, le rasoir jetable, la fermeture éclair, le soutien-gorge, l'acier inoxydable et la cellophane, sans oublier le Coca-Cola, les cornflakes, le sachet de thé et le filtre à café. Enfin, la culture, la science et la communication font un bond de géant : on invente le gramophone, le cinématographe, les mots croisés, la télégraphie sans fil, la radiographie aux rayons X et l'Aspirine, achevant de bâtir toute l'infrastructure de notre monde actuel en moins d'une génération.

Imaginez maintenant un gestionnaire moyen né en 1860, à la tête d'une manufacture textile à Lyon ou d'une scierie à Trois-Rivières. Il prend ses fonctions vers 1890 et les quitte vers 1920. En trente ans, il a vu les technologies de communication s'emballer — du courrier postal au télégraphe, puis au téléphone —, chacune redéfinissant ce que signifie « urgent ». Il a connu deux paradigmes énergétiques pour son atelier : la vapeur au charbon, puis l'électricité avec ses moteurs autonomes. Il a vu défiler trois modes de transport différents pour ses marchandises. Et la carte politique qu'il avait apprise enfant était devenue méconnaissable en 1914 — alors qu'il n'avait encore rien vu de la Grande Guerre.

Comme aujourd'hui, ces changements étaient vertigineux. Dès 1893, Durkheim a donné un nom à ce ressenti : l'anomie — l'absence de repères et de règles. Weber parle du désenchantement du monde en 1905, pendant que Freud écoute des bourgeois viennois lui raconter une étrange fatigue dont la médecine ne savait que faire. Beaucoup de gens, en effet, ont craqué.

Aux grands maux les grands remèdes

Mais cette même période de chaos n'a pas seulement réinventé les objets, elle a fondé à peu près toutes les institutions modernes du travail et de la pensée. C'est l'époque où le monde ouvrier s'organise face aux excès industriels avec l'essor des grands syndicats comme la CGT en 1895, et où naissent le droit du travail et les premières assurances sociales sous l'impulsion de Bismarck en Allemagne dès 1883, posant les premiers jalons de l'État-providence. Pour encadrer cette économie devenue géante, on invente la figure du gestionnaire professionnel en créant les premières grandes écoles de commerce, de Wharton et HEC en 1881 à la Harvard Business School en 1908. En parallèle, la médecine moderne triomphe et double l'espérance de vie grâce aux révolutions de Pasteur et Koch, qui terrassent les épidémies par la vaccination et la bactériologie. Le travail lui-même devient une science, parfois brutale, avec la psychologie du travail et l'organisation scientifique de Taylor en 1911, tandis que les sciences sociales s'émancipent comme des disciplines à part entière sous la plume de Durkheim, Weber ou Veblen pour tenter de cartographier cette mutation humaine inédite.

Et les colosses nés de cette grande secousse ont tenu plus d'un siècle. Des empires comme General Electric et Coca-Cola fondés en 1892, Michelin en 1889, Renault en 1899, Ford en 1903, ou encore IBM en 1911 et Sears en 1893, sont tous nés au cours de ces quelques décennies de bouleversements intenses. Ces piliers du capitalisme mondial, qui ont traversé deux guerres mondiales, des crises systémiques et la transition numérique, ont tous été forgés au cœur de l'époque la plus inconfortable, la plus mouvante et la plus vertigineuse jamais traversée par l'Occident moderne.

Donc…

La leçon à retenir n'est pas que « tout finit par s'arranger ». Ce serait trop facile. La vérité, c'est que les moments où le changement semble totalement hors de contrôle sont précisément ceux où s'inventent les structures de demain. L’inconfort précède toujours la fondation. À l'époque, Durkheim, Weber et Taylor ont simplement transformé leur propre sentiment de dépassement en outils pour repenser le travail et la société.

Aujourd'hui, les managers épuisés que l'on croise partout depuis quelques années vivent exactement le même inconfort historique. Pris en étau entre l'explosion de l'IA, le travail hybride, les tensions économiques mondiales et le choc culturel des générations, ils ont toutes les raisons d'être au bout du rouleau.

Mais sans le savoir, ce sont eux qui sont en train de dessiner les règles du jeu pour les trente prochaines années.

Ce ne sont pas les grands cabinets de conseil comme Gartner ou McKinsey qui vont inventer les rituels d'équipe à l'ère de l'IA, ou trouver comment faire collaborer quatre générations qui ne se comprennent pas. Ce sont les managers de terrain. Chaque jour, à coups de micro-décisions, de discussions informelles et d'ajustements techniques, ils réécrivent le contrat de travail de notre époque.

C'est moins une crise qu'un chantier. La différence est dans le regard, mais elle change tout.

Que vous le vouliez ou non, le contexte dans lequel vous évoluez change. Nouvelles attentes des consommateurs, nouvelles tendances, nouvelles réglementations, nouveau contexte concurrentiel... Ces éléments externes s'ajoutent aux changements que vous faites vous-mêmes : nouveaux produits, nouvelles aptitudes, nouvelles embauches, nouveau processus ou nouveau système informatique... Tout change dehors, et tout change dedans.

Les deux défis du changement

Deux défis se posent alors. Et c'est à Luc de Brabandère, de Boston Consulting Group, que l'on doit ces observations pertinentes. D'abord, vous devez décider d'un rythme acceptable pour "arrêter la machine" et réfléchir. Cette fréquence dépend de votre industrie, de votre capacité à inventer de nouvelles solutions ou d'opérationnaliser le changement.

Deuxième défi : vivre avec vos décisions raisonnablement. Si vous décidez d'une nouvelle stratégie chaque semaine, votre organisation ne pourra pas suivre. Vous devez donc attendre le "prochain rendez-vous" stratégique pour prendre une nouvelle décision. Il se crée alors un stress qui repose sur les épaules des gestionnaires : être tentés de changer... mais devoir attendre, pour ne pas devenir une "poule sans tête".

Le troisième défi : créer un équilibre entre agilité et constance.

Agilité vs constance

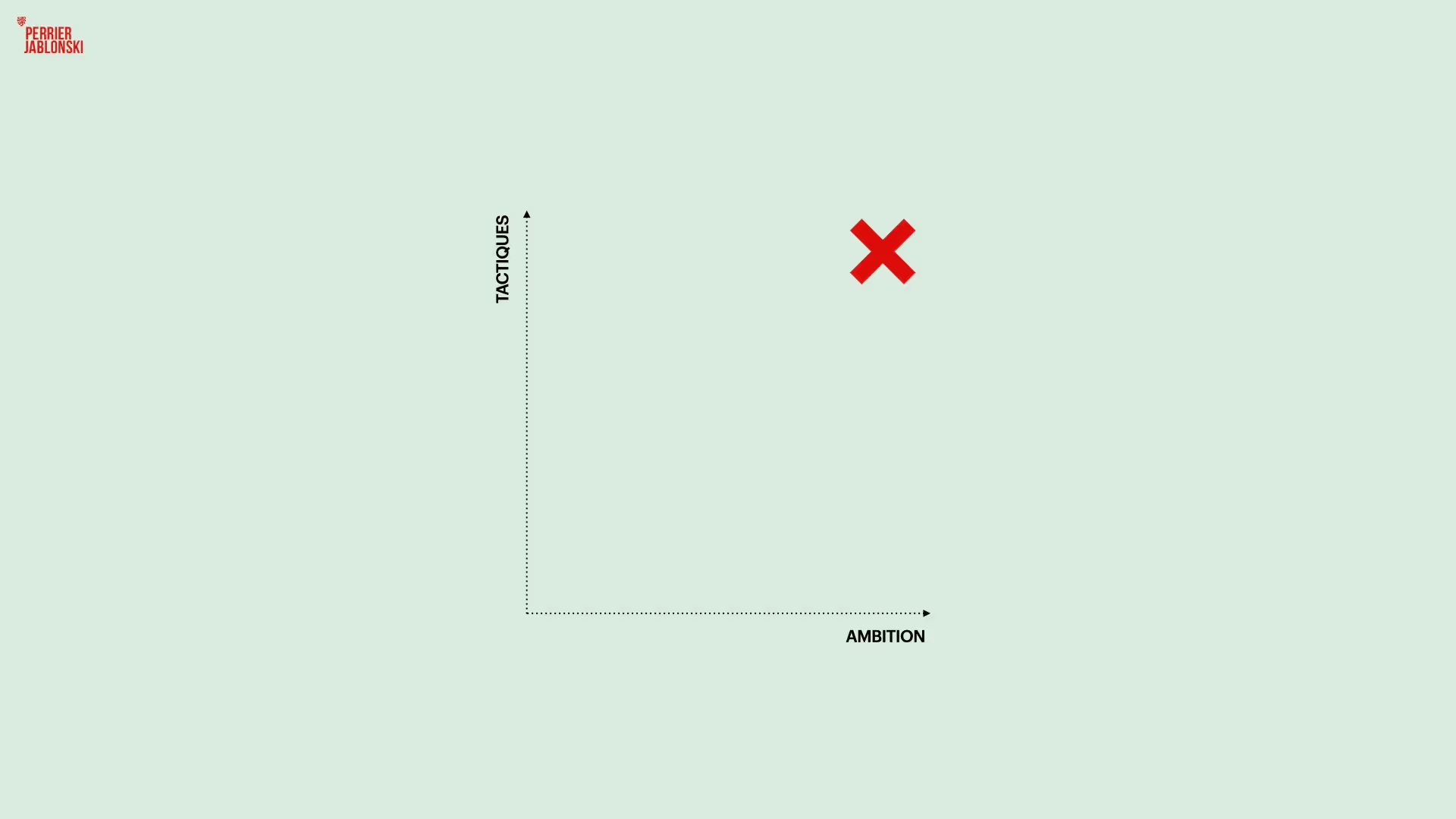

C'est à l'auteur John Coleman, collaborateur régulier du Harvard Business Review que l'on doit cette observation et propose un cadre de réflexion intéressant pour avancer. Il oppose l'agilité et la constance sur deux axes, ce qui permet d'identifier quatre profils d'entreprise.

Manque de sérieux : ni inspirantes, ni fiables, ces organisations n'ont aucune chance d'être comprises en interne ou à l'externe.

Manque de focus : certaines startups sont très agiles, mais elles manquent du focus nécessaire à rassurer les employés, les actionnaires, l'industrie, etc.

Trop de rigidité : de l'autre côté du spectre, les grandes organisations, les institutions financières ont une obligation morale à "protéger et servir". C'est ce qu'on attend d'elles. Mais cette fiabilité vient avec un coût : la rigidité.

Le Graal : la position désirée, c'est un équilibre entre l'agilité et la constance. Oui, mais comment? Nos missions en entreprise nous permettent d'émettre une théorie très très simple. Très.

La cohérence

Afin de devenir une entreprise cohérente, il faut créer un écosystème de décisions cohérent. D'abord, avec une ambition claire (ce que certains appellent une vision). C'est votre destination désirée, et réaliste : nous voulons devenir cela. Ensuite, cette ambition doit devenir le filtre actif de toutes les tactiques de votre plan. Posez-vous la question suivante : ce petit pas tactique mène-t-il au bon endroit stratégique? Si la réponse est oui, alors vous devez avancer. Sinon, vous savez quoi faire...