L'humain peine encore à comprendre sa propre nature : conscience, raisonnement, intelligence émotionnelle et mentale... autant de domaines qui restent à élucider. Si notre compréhension de notre propre intelligence est encore imparfaite, comment pourrions-nous alors la programmer dans un algorithme ? L'avènement de l'IA nous pousse à réexaminer ces concepts, à questionner leur sens et notre compréhension.

Selon une définition générale, l'intelligence implique la faculté d'adaptation, la capacité à faire des choix, à adopter un certain comportement ou à poursuivre une intention. Or, à ce jour, l'intelligence artificielle ne possède pas ces capacités. Si on s'en tient simplement à une définition plus technique de l'intelligence, qui ressemblerait à celle de l'intel des anglos — le renseignement, l'information —, alors le « robot OpenAI » n'est pas plus intelligent qu'un moteur de recherche. Cependant, il est bien plus puissant mais il camoufle ses lacunes derrière une façade de certitude — ce que Gemini semble éviter.

Un avocat new-yorkais en a fait l'amère expérience en mai 2023. Préparant ses plaidoiries à partir de recherches légales effectuées par ChatGPT, il s'est rendu compte que la majorité des informations étaient purement inventées par le système. Pour vous en convaincre, faites un test : recherchez des informations sur un sujet qui vous est inconnu, vous serez probablement impressionnés. En revanche, sur un sujet que vous maîtrisez, le résultat pourrait bien vous faire rire.

Le Petit Robert nous rappelle que le mot « artificiel » a une multitude de sens. Artificiel veut dire « faux » (des fleurs artificielles), il veut dire « fait par l'humain et pas par la nature » (un lac artificiel), mais aussi « qui manque de naturel, forcé, exagéré » (une gaieté artificielle), mais aussi « arbitraire, qui ne tient pas compte des faits réels » (une classification artificielle), ou encore « non-humain » (une jambe artificielle). Or aujourd'hui, on considère uniquement l'intelligence artificielle comme étant non-humaine — et c'est vrai.

Histoire de la remettre à sa juste place, il convient de considérer l'intelligence artificielle au prisme de TOUTES les définitions de l'artificiel. Dès lors, il est tout aussi vrai qu'elle est fausse, faite par l'humain, elle manque de naturel, elle est arbitraire et elle échappe aux faits réels.

Évidemment que l'I.A. est impressionnante, elle peut générer une quantité d'information vertigineuse — et la formuler de manière crédible. Sa capacité à chercher, trouver et formuler rapidement donne une illusion d'intelligence, mais en aucun cas il s'agit d'arbitrage, d'opinion, ou de morale. Dès lors intelligence artificielle est un abus de langage. Il n'est pas question de conscience, mais bien de puissance — au sens technologique.

L'intelligence artificielle repose (encore) sur la gestion de l'erreur. La machine dit « voici tel résultat, avec telle estimation de mon erreur. » Un humain doit alors évaluer la qualité de cette estimation (je simplifie, ok?) À force de rétroactions, la machine affine ses prédictions et elle devient meilleure.

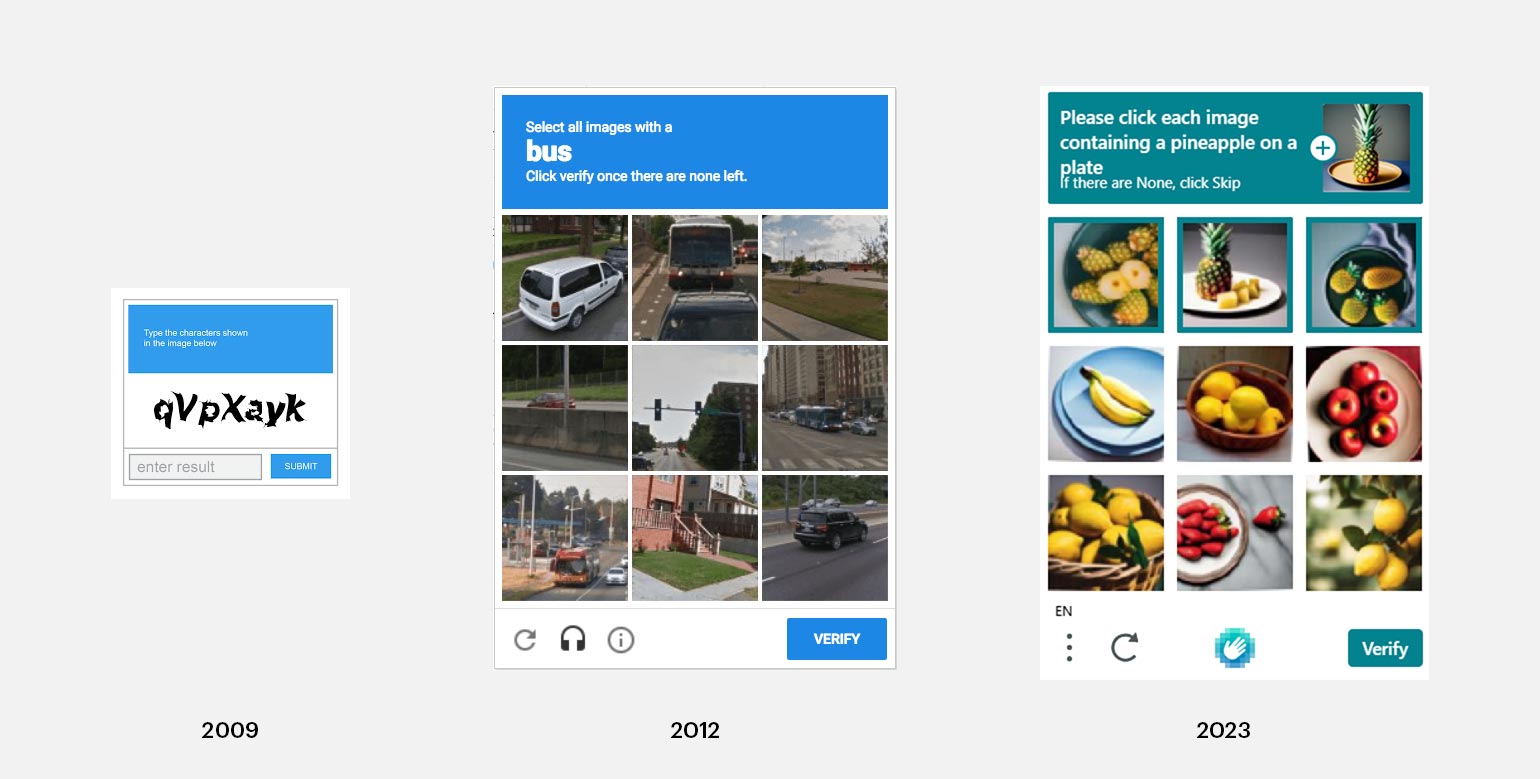

C'est d'ailleurs la raison du rachat de l'entreprise reCaptcha — cette petite boîte qui vous demande sans arrêt de confirmer que vous êtes un humain — par Google en 2009. En quelques années, on est passés de « quels sont les caractères bizarres écrits ci-dessous? » à « cliquez sur les images de Street View où vous voyez un bus ». Ce changement s'est produit en 2012. Pourquoi? Parce que Google avait besoin de validation de masse. Elle devait vérifier la précision des prédictions de son algorithme. Sur les cases 1 à 9, l'algorithme estime avoir identifié un bus dans les images 2, 6 et 7, avec un taux de confiance — confidence score — de x% (je simplifie encore, hein!) C'est votre tour, à vous de déclarer où vous voyez un bus! Ce faisant, vous (un humain) validez simplement la prédiction d'une I.A., et vous améliorez sans le savoir un algorithme. Cette vérification, multipliée par des millions chaque jour, est une manne de main-d'œuvre gratuite au service d'une machine qui donne des airs d'autonomie.

Depuis le début de l'année dernière, ces images de Google Street ont été remplacées... par des images générées par de l'I.A. Encore une fois, c'est vous qui faites le boulot de valider ou corriger la machine.

Google n'a pas racheté reCaptcha pour sécuriser les sites web du monde entier, mais pour nous faire travailler gratuitement.

Mais ce n'est pas tout. Dans plusieurs pays du monde (Kenya, Madagascar, Inde, Venezuela, Argentine…) des ressources « humaines » sont employées à bas coût pour effectuer ce genre de tâches de validation (ou de censure), mais aussi pour nourrir les machines de leur savoir. Des jobs si mal payées qu'elle créent un Tiers Monde 2.0. Cette exportation du travail dégradant de l'I.A. est si massive que les experts la qualifient de « recolonisation ».✱

Pendant ce temps, nous regardons la locomotive, ébahis par le génie de la machine, ignorant tout de ceux qui la nourrissent de charbon, à la force de leur bras, au prix de leur sueur et parfois de leur sang.

Pour l'instant, l'intelligence artificielle a besoin de BEAUCOUP de ressources humaines pour avoir l'air… humaine.

Pour l'instant (la nuance est importante), l'intelligence artificielle n'a rien d'intelligent et tout d'artificiel.

Le bon fonctionnement des I.A. génératives repose sur un accès à un volume de données immense qui repose elle-même sur... des connaissances humaines.

Des mathématiques mésopotamiennes à la relativité d'Einstein, de la sagesse de Lao Tseu à la poésie de Ferland, de Thalès à Henri Bergson, toute production de connaissance est un acte humain délibéré. Toute découverte, le fruit d'un labeur. Toute trouvaille, le résultat d'une quête obsédée. Toute création est la sueur d'une conscience, d'un effort, d'une maturation humaine. Dès lors, notre savoir, notre culture et nos croyances sont un magma de récits, de réflexions et de pensées millénaires, mûries au fil de notre lente évolution.

Ensuite, ces connaissance ont dû être collectées par des humains méticuleux. Tout fragment de savoir a été validé par des humains, trié, catégorisé, classé et indexé par des humains.

Ce corpus de connaissances a été rassemblé en grimoires, en ouvrages, en encyclopédies, en dictionnaires, en manifestes, en herbiers et cabinets de curiosités de toutes sortes, en bibliothèques et en collections muséales, puis finalement en serveurs informatiques. Tout cela a été le travail acharné et entêté d'humains décidés à partager le savoir.

De siècle en siècle, cette tâche a été facilitée par des techniques qui se sont additionnées. L'écriture (mésopotamienne), le papier (chinois), l'imprimerie (germanique), l'informatique puis l'internet ont été des accélérateurs puissants de cette conservation du savoir, et ces inventions ont été des actes créatifs humains délibérés.

Aujourd'hui l'I.A. repose sur des algorithmes créés par des humains — tout comme l'électricité, la physique, l'électronique, la logique et les mathématiques qui les ont rendus possibles.

La volonté même de voir une machine penser comme nous est humaine. Rien ne découle d'un désir « deus ex machina » (dieu sorti de la machine).

Mais soudain, le résultat sort de l'automate, et l'on crie au génie et à la magie, louant cette capacité soudaine des machines à « créer par elles-mêmes ».

L'époque croit dur comme fer que le lapin est vraiment sorti du chapeau sous le coup de la baguette magique.

Au risque de décevoir les croyants, les machines n'ont pas cette capacité de créer. Elles n'en ont ni la technique, ni le savoir-faire, ni le talent, ni l'intention, ni la volonté, ni le pouvoir. Elles ne font que suivre des ordres, qu'exécuter des commandes, que reproduire des mécanismes, pensés et enseignés par des humains.

Mais face aux prouesses des I.A., on oublie les fils de la marionnette et la main qui la contrôle. Mais où est passée notre fierté d'homo sapiens? Quel âge avons-nous pour croire aux magiciens?

Nous sommes encore TRÈS loin de l'Intelligence Artificielle Générale promise par OpenAI. Tout est humain dans l'intelligence artificielle.

GPT signifie Generative Pre-trained Transformer. Il s'agit pour l'I.A. de générer des contenus, au-delà de simplement les compiler. Générer du texte, des images, de la musique, en s'entraînant sur des masses importantes de données. Par exemple, après quelques commandes très simples auprès de MidJourney, Stable Diffusion ou Dall-e, l'ordinateur vous fait quelques propositions de « création ». C'est bluffant. Avec de l'entraînement, cela devient fascinant.

Mais ce n'est pas une création. C'est un collage malicieux d'images recherchées sur le net, dépouillées de leurs droits d'auteurs et savamment mélangées sans aucune autorisation, pour en créer une autre. Philosophiquement, le procédé se défend. L'artiste lui-même ne fait-il pas la même démarche d'inspiration et de collages dans son esprit?

Mais légalement c'est une autre histoire. En janvier 2023, GettyImage a poursuivi ces trois plateformes pour violation de droits d'auteur, après avoir retrouvé son propre logo dans des créations censées être originales. En retour, Emad Mostaque, le patron de Stable Diffusion a sèchement répondu sur Twitter « models and data for all », brandissant encore le mythe de l'open source. Voulait-il dire « from all »?

Saviez-vous que les abeilles sont capables de faire de la reconnaissance faciale avec un cerveau d'un millimètre cube? Elles savent même compter jusqu'à 8! En plus de ce miracle de miniaturisation, l'insecte fait tout cela sans intervention humaine, en totale autonomie énergétique — le tout en veillant à l'équilibre de notre agriculture, donc à notre survie.✱

Pour la même opération, un ordinateur a besoin d'une quantité astronomique d'énergie, sans compter l'impact environnemental écrasant de sa fabrication.

La prouesse de l'abeille, c'est de réaliser une tâche complexe avec très peu d'énergie.

La prouesse de l'humain, c'est la neuro plasticité : notre cerveau se reconfigure biologiquement sans cesse, pour effectuer des tâches complexes avec moins d'énergie. Réalisez à quel point tenir en équilibre sur un vélo est un miracle de complexité pour notre cerveau! Et pourtant, à force, nous le faisons sans même y penser!

Pour vous donner une image de la puissance du cerveau humain, une collaboration internationale entre chercheurs japonais (Riken et OIST) et allemands (Institute of Neuroscience and Medicine, Forschungszentrum Jülich) a effectué une simulation sans précédent de l'activité cérébrale humaine grâce au supercalculateur K de Fujitsu (TOP4 des plus puissants ordinateurs au monde en 2013, année de l'étude)

Ce super calculateur représente la puissance de 83.000 ordinateurs et la mémoire de 250.000 ordinateurs.

Alors combien de temps pour calculer 1 seconde de 1% d'un cerveau?! 40 minutes! Notre cerveau est un super calculateur d'une puissance infinie comparée à n'importe quelle I.A. du monde… et pour longtemps! Et nous faisons tout cela au prix minime de 2000 à 2500 calories par jour!✱

En passant, c'est à peu près (1800 cal.) l'énergie nécessaire à une ruche de 50 à 60.000 individus pour fonctionner quotidiennement en été.✱

Au final, la prouesse de l'I.A., c'est de… faire quelque chose à notre place. Ok, mais à quel prix? Pour quels impacts? ChatGPT a lui seul mobilise 3617 serveurs, et un total de 28936 processeurs graphiques (GPU). D'après SemiAnalysis (2023), cet arsenal consomme à peu près 564 MWh par jour. C'est plus que la production journalière d'Hydro-Québec en 2022, avec 554 MWh.✱

J'ai posé la question à ChatGPT de son impact sur l'environnement. La réponse est sans équivoque et prouve le manque total de conscience : « c'est pas moi, ce sont mes serveurs » — traduire « j'en n'ai rien à foutre! ».

Concrètement, la recherche en intelligence artificielle est principalement ❶ privée, ❷ masculine... ❸ blanche.

Il faut constater avec prudence plusieurs échecs de l'I.A. sur le plan de la démocratie — dans le sens du pouvoir et de la représentativité du peuple, bien que la démocratie fut elle-même un mythe, dès son berceau à Athènes (sujet pour lequel je vous redirigerais vers l'historien Patrice Brun)

Commençons par quelques exemples.

D'abord celui de la reconnaissance faciale chez les personnes noires, pour qui le risque d'erreur est multiplié par 100, ce qui a été dénoncé par Amnesty Internationale.

Ensuite, l'objectification de la femme, permise par les outils de création d'images, qui facilitent la surproduction d'images sursexualisées. Dernier exemple concret : les deep-fakes pornographiques de la chanteuse Taylor Swift ont été vus 47 millions de fois avant d'être stoppées… 17 heures plus tard par la plateforme de l'uuuuultra libéral Elon Musk, laissant amplement le temps à la bulle conservatrice américaine de s'enflammer contre la chanteuse.

Ensuite, la perpétuation des biais, comme dans le cas d'Amazon, qui avait mis en place un système de recrutement automatisé en 2014. Le but : recruter les meilleurs CV en se basant sur leurs données historiques. Résultat? La machine a proposé... des hommes blancs en grande majorité, perpétuant les bonnes vieilles habitudes de recrutement du groupe.

Enfin, le biais scandaleux de l'algorithme COMPAS (Correctional Offender Management Profiling for Alternative Sanctions) utilisé présentement dans le système judiciaire américain. L'idée? Prédire la probabilité de récidive d'un délinquant. Or, le modèle a prédit deux fois plus de faux positifs chez les délinquants noirs (45 %) que les délinquants blancs (23 %). On est carrément dans un Minority Report buggé!

Ce sont des hommes blancs et riches qui programment les machines. Et, même voulant bien faire, ils se prennent les doigts dans les curseurs de la diversité.

La semaine dernière, un épisode d'hallucination de Gemini a créé l'émois. Quelle que soit la demande de génération d'images faite à la nouvelle I.A. de Google, tous les résultats représentaient des personnes noires ou asiatiques : Vikings, autochtones ou nazis. L'incident n'a pas échappé à l'uuuuultra libéral Elon Musk, qui en a profité pour pointer le woksime des modèles d'I.A. existantes. Ben tiens…

On voit bien le lien ténu entre ces nouveaux outils technologiques et la récupération politique. Oui, l'I.A. est une promesse de progrès… à condition que vous soyez un homme blanc riche. Dans les faits, elle n'est pour l'instant qu'une machine à exacerber les discriminations, qu'un accélérateur de problèmes sociétaux, qu'un générateur de commotions politiques inutiles.

Et ce n'est pas vraiment la définition du progrès.

Quand viendra le temps de prendre position, ou de prendre des décisions importantes, comment l'IA va-t-elle raisonner? Admettons que nous lui demandions son avis sur la peine de mort, le port d'arme, ou plus simplement l'application d'une loi, l'interprétation d'une consigne? Comment va-t-elle pouvoir répondre?

Prenons l'exemple du port d'arme. Comment décider? En prenant en compte le point de vue des deux camps

blablabl